Assistente do Wells Fargo, desenvolvido com IA do Google, preparado para atingir 100 milhões de interações anualmente

12 de janeiro de 2024

As 5 principais histórias de dados de 2023: a atuação da Microsoft na guerra da nuvem, a aquisição da Databricks e muito mais

12 de janeiro de 2024Capturar sinais fracos em endpoints e prever possíveis padrões de tentativas de intrusão é um desafio perfeito para os Large Language Models (LLMs). O objetivo é explorar dados de ataque para encontrar novos padrões e correlações de ameaças enquanto ajusta LLMs e modelos.

Os principais fornecedores de detecção e resposta de endpoint (EDR) e detecção e resposta estendida (XDR) estão assumindo o desafio. Nikesh Arora, presidente e CEO da Palo Alto Networks, disse: “Coletamos a maior quantidade de dados de endpoint do setor a partir do nosso XDR. Coletamos quase 200 megabytes por endpoint, o que é, em muitos casos, 10 a 20 vezes mais do que a maioria dos participantes do setor. Porque você faz isso? Como pegamos esses dados brutos e correlacionamos ou aprimoramos a maioria de nossos firewalls, aplicamos gerenciamento de superfície de ataque com automação aplicada usando XDR.”

O cofundador e CEO da CrowdStrike, George Kurtz, disse ao público principal no evento anual Fal.Con da empresa no ano passado: “Uma das áreas em que realmente fomos pioneiros é que podemos captar sinais fracos de diferentes terminais. E podemos ligá-los para encontrar novas detecções. Agora estamos estendendo isso aos nossos parceiros terceirizados para que possamos analisar outros sinais fracos não apenas em endpoints, mas também em domínios e criar uma nova detecção.”

O XDR provou ser bem-sucedido no fornecimento de menos ruído e melhores sinais. Os principais fornecedores de plataformas XDR incluem Broadcom, Cisco, CrowdStrike, Fortinet, Microsoft, Palo Alto Networks, SentinelOne, Sophos, TEHTRIS, Trend Micro e VMWare.

Por que os LLMs são o novo DNA da segurança de endpoint

Aprimorar LLMs com telemetria e dados anotados por humanos define o futuro da segurança de endpoint. No mais recente Hype Cycle for Endpoint Security do Gartner, os autores escrevem: “As inovações de segurança de endpoint se concentram na detecção e prevenção mais rápidas e automatizadas, e na remediação de ameaças, potencializando detecção e resposta estendida e integrada (XDR) para correlacionar pontos de dados e telemetria do endpoint, soluções de rede, web, e-mail e identidade.”

Os gastos com EDR e XDR estão crescendo mais rapidamente do que o mercado mais amplo de segurança da informação e gerenciamento de riscos. Isso está criando níveis mais elevados de intensidade competitiva entre os fornecedores de EDR e XDR. O Gartner prevê que o mercado de plataformas de proteção de endpoint crescerá dos US$ 14,45 bilhões atuais para US$ 26,95 bilhões em 2027, atingindo uma taxa composta de crescimento anual (CAGR) de 16,8%. Prevê-se que o mercado mundial de segurança da informação e gestão de riscos cresça de US$ 164 bilhões em 2022 para US$ 287 bilhões em 2027, atingindo um CAGR de 11%.

CTO da CrowdStrike sobre como os LLMs fortalecerão a segurança cibernética

VentureBeat conversou recentemente (virtualmente) com Elia Zaitsev, CTO da CrowdStrike para entender por que o treinamento de LLMs com dados de endpoint fortalecerá a segurança cibernética. Seus insights também refletem a rapidez com que os LLMs estão se tornando o novo DNA da segurança de endpoints.

VentureBeat: Qual foi o catalisador que o levou a começar a olhar para os dados de telemetria de endpoint como uma fonte de insights que poderiam eventualmente ser usados para treinar LLMs?

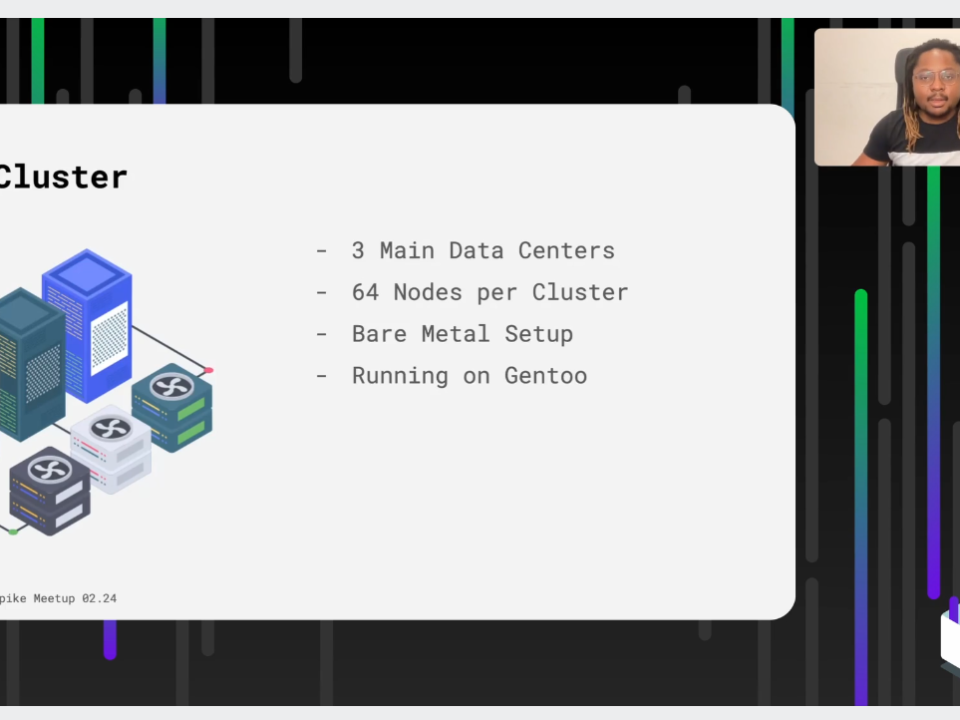

Elia Zaitsev: “Portanto, quando a empresa foi fundada, uma das razões pelas quais ela foi criada como uma empresa nativa da nuvem é que queríamos usar tecnologias de IA e ML para resolver problemas difíceis dos clientes. Porque se você pensar nas tecnologias legadas, tudo estava acontecendo na borda, certo? Você estava tomando todas as decisões e todos os dados viviam no limite, mas tínhamos essa ideia de que se você quisesse usar a tecnologia de IA, você precisava ter, especialmente para aquelas soluções mais antigas do tipo ML, que ainda estão no caminho , muito efetivo. Você precisa dessa quantidade de informações e só poderá obtê-la com uma tecnologia de nuvem, onde poderá trazer todas as informações.

Poderíamos treinar esses classificadores pesados na nuvem e então implantá-los na borda. Portanto, treine na nuvem, implemente até a borda e tome decisões inteligentes. O engraçado, porém, é que está acontecendo agora que a IA generativa está ganhando destaque e são tecnologias diferentes. Trata-se menos de decidir o que é bom e o que é ruim e mais de capacitar os seres humanos, como pegar um fluxo de trabalho e acelerá-lo.”

VentureBeat: Qual é a sua perspectiva sobre LLMs e ferramentas de geração de IA substituindo profissionais de segurança cibernética?

Zaitsev: “Não se trata de substituir seres humanos, trata-se de aumentar os humanos. É aquele humano assistido por IA, que eu acho que é um conceito chave, e acho que muitas pessoas na tecnologia, e direi isso como CTO, devo me concentrar na tecnologia, o foco às vezes também vai longe de querer substituir os humanos. Acho que isso é muito equivocado, especialmente na área cibernética. Mas quando pensamos na forma como a tecnologia subjacente funciona, a geração AI, na verdade não se trata necessariamente de quantidade. A qualidade se torna muito mais importante. Você precisa de muitos dados para criar esses modelos para começar, mas quando chega a hora de realmente ensiná-los a fazer algo específico, e isso é fundamental quando você quer sair daquele modelo geral que pode falar inglês ou qualquer outro idioma, e você quer fazer o que é chamado de ajuste fino quando quer ensiná-lo, como fazer algo como resumir um incidente para um analista de segurança ou operar uma plataforma, esses são os tipos de coisas que nosso produto generativo Charlotte AI está fazendo.”

VentureBeat: Você pode discutir como tecnologias de automação como LLM afetam o papel dos humanos na segurança cibernética, especialmente no contexto do uso de IA por adversários e da corrida armamentista contínua em ameaças cibernéticas?

Zaitsev: “A maioria dessas tecnologias de automação, sejam LLMs ou algo parecido, não tendem a substituir realmente os humanos. Eles tendem a automatizar as tarefas básicas mecânicas e permitem que os humanos especialistas gastem seu valioso tempo e se concentrem em algo mais difícil. Normalmente, as pessoas começam a perguntar: e os adversários que usam IA? E para mim é uma conversa bem simples. Numa corrida armamentista típica, os adversários usarão IA e outras tecnologias para automatizar alguns níveis básicos de ameaças. Ótimo. Você usa IA para neutralizar isso. Então você equilibra isso e o que resta? Você ainda tem um atacante humano muito experiente e inteligente acima do barulho, e é por isso que ainda precisará de um defensor realmente inteligente e experiente.”

VentureBeat: Quais são as lições mais valiosas que você aprendeu usando dados de telemetria para treinar LLMs?

Zaitsev: “Quando construímos LLMs, é realmente mais fácil treinar muitos LLMs pequenos nesses casos de uso específicos. Então pegue aquele conjunto de dados Overwatch, aqueles dados Falcon Complete, aquele conjunto de dados Intel (ameaça). Na verdade, é mais fácil e menos propenso a alucinações adotar um modelo de linguagem grande e pequeno, criado especificamente para esse fim, ou talvez chamá-lo de modelo de linguagem pequeno, se preferir.

Na verdade, você pode ajustá-los e obter maior precisão e menos alucinações se estiver trabalhando em um menor, construído especificamente para esse fim, do que tentar pegar esses grandes monolíticos e fazê-los parecer um pau para toda obra. Então o que usamos é um conceito chamado mistura de especialistas. Na verdade, em muitos casos, você obtém melhor eficiência com essas tecnologias LLM quando tem especialização, certo? Alguns LLMs realmente desenvolvidos para um propósito específico trabalhando juntos em vez de tentar obter um superinteligente que na verdade não faz nada particularmente bem. Ele faz muitas coisas mal em comparação com qualquer coisa particularmente bem.

Também aplicamos validação. Deixaremos os LLMs fazerem algumas coisas, mas também verificaremos o resultado. Vamos usá-lo para operar a plataforma. Em última análise, baseamos as respostas em nossa telemetria na API de nossa plataforma para que haja alguma confiança nos dados subjacentes. Não é só sair do éter, do cérebro do LLM, por assim dizer, né? Está enraizado em um fundamento de verdade.

VentureBeat: Você pode explicar a importância e o papel das equipes humanas especializadas no desenvolvimento e treinamento de sistemas de IA, especialmente no contexto da abordagem de longo prazo da sua empresa para tarefas humanas assistidas por IA, em vez de substituídas por IA?

Zaitsev: Quando você começa a fazer esses tipos de casos de uso, não precisa de milhões, bilhões e trilhões de exemplos. Na verdade, o que você precisa é, em muitos casos, de alguns milhares, talvez dezenas de milhares de exemplos, mas precisa ser de altíssima qualidade e, idealmente, o que chamamos de conjuntos de dados anotados por humanos. Basicamente, você quer que um especialista diga aos sistemas de IA: é assim que eu faria, aprenda com meu exemplo. Portanto, não vou levar o crédito e dizer que sabíamos que o boom da IA generativa iria acontecer há 11, 12 anos, mas como sempre acreditamos apaixonadamente nesta ideia de a IA ajudar os humanos e não substituir os humanos, configuramos todos essas equipes humanas de especialistas desde o primeiro dia.

Acontece que, como temos investido de muitas maneiras exclusivamente em nossa capacidade humana e construído esses dados de plataforma anotados por humanos de alta qualidade, agora, de repente, temos essa mina de ouro, certo, esse tesouro exatamente do o tipo certo de informações de que você precisa para criar esses modelos generativos de linguagem em grande escala de IA, especificamente ajustados para casos de uso de segurança cibernética em nossa plataforma. Então, um pouco de boa sorte aí.

VentureBeat: Como os avanços que você está fazendo com o treinamento de LLMs estão compensando os produtos atuais e futuros?

Zaitsev: Nossa abordagem, vou usar o velho ditado quando tudo que você tem é um martelo, tudo parece um prego, certo? E isso não é verdade apenas para a tecnologia de IA. É a forma como abordamos as camadas de armazenamento de dados. Sempre fomos fãs desse conceito de usar todas as tecnologias porque quando você não se limita a usar uma coisa, você não precisa. Então Charlotte é um sistema multimodal. Ele usa vários LLMs, mas também usa tecnologia não LLM. LLMs são bons em seguir instruções. Eles pegarão interfaces de linguagem natural e as converterão em tarefas estruturadas.

VentureBeat: Seus LLMs estão treinando em dados de clientes ou vulnerabilidades?

Zaitsev: A saída que o usuário vê do Charlotte quase sempre é baseada em alguns dados da plataforma. Por exemplo, informações de vulnerabilidade do nosso produto Spotlight. Podemos pegar esses dados e depois dizer a Charlotte para resumi-los para um leigo. Novamente, coisas em que os LLMs são bons e podemos treiná-las com base em nossos dados internos. A propósito, isso não é específico do cliente. São informações gerais sobre vulnerabilidades e é assim que lidamos com os aspectos de privacidade. Os dados específicos do cliente não são treinamento em Charlotte, são o conhecimento geral das vulnerabilidades. Os dados específicos do cliente são alimentados pela plataforma. Então é assim que mantemos a separação entre Igreja e Estado, por assim dizer. Os dados privados estão na plataforma Falcon. Os LLMs são treinados e possuem conhecimento geral de segurança cibernética e, em qualquer caso, certifique-se de nunca expor esse LLM puro ao usuário final para que possamos aplicar a validação.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.