A startup de São Francisco, KeepX, levanta US$ 50 milhões para levar IA às operações industriais

13 de janeiro de 2024

A avaliação da VAST Data sobe para mais de US$ 9 bilhões após novo financiamento

13 de janeiro de 2024Hoje a Databricks anunciou novas ferramentas de geração aumentada de recuperação (RAG) para sua plataforma de inteligência de dados para ajudar os clientes a construir, implantar e manter aplicativos de modelo de linguagem grande (LLM) de alta qualidade direcionados a diferentes casos de uso de negócios.

Disponíveis em versão prévia pública a partir de hoje, as ferramentas abordam os principais desafios no desenvolvimento de aplicativos RAG de nível de produção. Isso vai desde o fornecimento de dados de negócios relevantes em tempo real de diferentes fontes até a combinação desses dados com o modelo certo para a aplicação desejada e o monitoramento dessa aplicação quanto à toxicidade e outros problemas que muitas vezes afetam os LLMs.

“Embora haja uma urgência em desenvolver e implantar aplicativos de geração aumentada de recuperação, as organizações lutam para fornecer soluções que forneçam consistentemente respostas precisas e de alta qualidade e tenham as proteções apropriadas para evitar respostas indesejáveis e fora da marca”, Craig Wiley, sênior diretor de produto de IA/ML da Databricks, disse ao VentureBeat.

As novas ferramentas visam exatamente esse problema.

O que é RAG e por que é tão difícil?

Os LLMs estão na moda, mas a maioria dos modelos contém conhecimento parametrizado, o que os torna úteis para responder a solicitações gerais na velocidade da luz. Para tornar esses modelos mais atualizados e atender a tópicos específicos, especialmente para necessidades internas de negócios, as empresas buscam a geração aumentada de recuperação ou RAG. É uma técnica que utiliza certas fontes específicas de dados para aumentar ainda mais a precisão e a confiabilidade do modelo e melhorar a qualidade geral de suas respostas. Imagine um modelo sendo treinado com dados de RH para ajudar os funcionários com diversas dúvidas.

RAG envolve múltiplas camadas de trabalho. Você precisa coletar os dados estruturados e não estruturados mais recentes de vários sistemas, prepará-los, combiná-los com os modelos certos, fornecer instruções de engenharia, monitorar e muito mais. Este é um processo fragmentado, que deixa muitas equipes com aplicativos RAG de baixo desempenho.

Como o Databricks está ajudando

Com as novas ferramentas RAG em sua plataforma de inteligência de dados, a Databricks está resolvendo esse desafio, dando às equipes a capacidade de combinar todos os aspectos e criar rapidamente protótipos e enviar aplicativos RAG de qualidade para produção.

Por exemplo, com os novos recursos de pesquisa vetorial e serviço de recursos, o incômodo de construir pipelines complexos para carregar dados em uma camada de serviço personalizada desaparece. Todos os dados estruturados e não estruturados (das tabelas Delta) são automaticamente extraídos e sincronizados com o aplicativo LLM, garantindo acesso às informações de negócios mais recentes e relevantes para fornecer respostas precisas e conscientes do contexto.

“O Unity Catalog rastreia automaticamente a linhagem entre as cópias off-line e on-line dos conjuntos de dados servidos, facilitando muito a depuração de problemas de qualidade de dados. Ele também impõe consistentemente configurações de controle de acesso entre conjuntos de dados online e offline, o que significa que as empresas podem auditar e controlar melhor quem está vendo informações proprietárias confidenciais”, escreveram o cofundador e vice-presidente de engenharia da Databricks, Patrick Wendell, e o CTO de Redes Neurais, Hanlin Tang, em um comunicado conjunto. postagem no blog.

Então, com o playground unificado de IA e a avaliação MLFlow, os desenvolvedores têm a capacidade de acessar modelos de diferentes provedores, incluindo Azure OpenAI Service, AWS Bedrock e Anthropic e modelos de código aberto, como Llama 2 e MPT, e ver como eles se saem nas principais métricas como toxicidade, latência e contagem de tokens. Em última análise, isso permite que eles implantem seu projeto no modelo de melhor desempenho e mais acessível por meio do serviço de modelo – mantendo a opção de mudar sempre que algo melhor surgir.

Notavelmente, a empresa também está lançando APIs de modelo básico, um conjunto totalmente gerenciado de modelos LLM que são servidos na infraestrutura do Databricks e podem ser usados para o aplicativo com base em pagamento por token, proporcionando benefícios de custo e flexibilidade com dados aprimorados segurança.

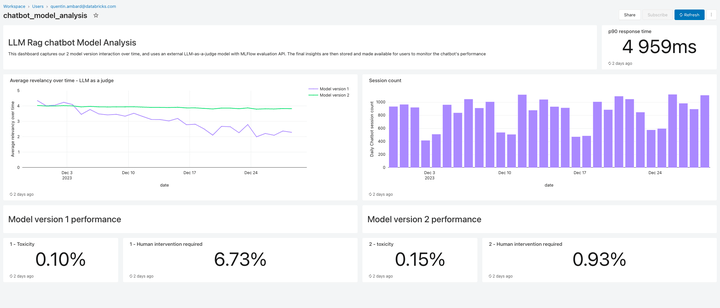

Depois que o aplicativo RAG for implantado, a próxima etapa é acompanhar seu desempenho no ambiente de produção, em escala. É aqui que entra o recurso Lakehouse Monitoring totalmente gerenciado da empresa.

O monitoramento Lakehouse pode verificar automaticamente as respostas de um aplicativo para verificar toxicidade, alucinações ou qualquer outro conteúdo inseguro. Esse nível de detecção pode então alimentar painéis, sistemas de alerta e pipelines de dados relacionados, permitindo que as equipes tomem medidas e evitem fiascos de alucinações em grande escala. O recurso é integrado diretamente à linhagem de modelos e conjuntos de dados, garantindo que os desenvolvedores possam entender rapidamente os erros e a causa raiz deles.

Adoção já em andamento

Embora a empresa tenha acabado de lançar as ferramentas, Wiley confirmou que várias empresas já estão testando e usando-as com a plataforma Databricks Data Intelligence, incluindo o fornecedor de RV Lippert e a EQT Corporation.

“Gerenciando um ambiente dinâmico de call center para uma empresa do nosso tamanho, o desafio de atualizar novos agentes em meio à rotatividade típica de agentes é significativo. O Databricks fornece a chave para nossa solução… Ao incluir conteúdo de manuais de produtos, vídeos do YouTube e casos de suporte em nossa Pesquisa de vetores, o Databricks garante que nossos agentes tenham o conhecimento necessário ao seu alcance. Esta abordagem inovadora é uma virada de jogo para a Lippert, aumentando a eficiência e elevando a experiência de suporte ao cliente”, observou Chris Nishnick, que lidera os esforços de dados e IA na Lippert.

Internamente, as equipes da empresa construíram aplicativos RAG usando as mesmas ferramentas.

“A equipe de TI da Databricks tem vários projetos internos em andamento que implantam IA generativa, incluindo o piloto de um slackbot RAG para executivos de contas encontrarem informações e um plugin de navegador para representantes de desenvolvimento de vendas e representantes de desenvolvimento de negócios para alcançar novos clientes em potencial”, disse Wileys.

Dada a crescente demanda por aplicativos LLM voltados para tópicos e assuntos específicos, a Databricks planeja “investir pesadamente” em seu conjunto de ferramentas RAG destinadas a garantir que os clientes possam implantar aplicativos LLM de alta qualidade com base em seus dados para produção, em escala. A empresa já realizou pesquisas significativas neste espaço e planeja anunciar mais inovações no futuro, acrescentou o diretor de produto.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.