Neon: ramificação no PostgreSQL sem servidor

25 de janeiro de 2024

Mojo combina a facilidade do Python com o desempenho do C++ e Rust

25 de janeiro de 2024SvelteKit 2.0 lançado no final de dezembro. A estrutura para construção de aplicativos com Svelte agora suporta Vite 5 e abre caminho para Svelte 5, que deverá ser lançado em 2024.

Ele também adiciona suporte para um “recurso muito solicitado”, observou a equipe em uma postagem no blog de lançamento do SvelteKit 2.0. Svelte chama isso de roteamento superficial e permite que os desenvolvedores “associem o estado a uma entrada no histórico sem causar navegação”, escreveu a equipe. Ele pode ser usado para criar uma caixa de diálogo modal que pode ser descartada deslizando para trás ou exibindo visualizações pop-up de rotas quando os desenvolvedores não desejam fazer uma navegação completa.

O lançamento marcou o aniversário de um ano de lançamento do SvelteKit.

“No ano passado, vimos vários projetos de código aberto como Storybook, Tailwind e Playwright apoiarem oficialmente o SvelteKit, bem como várias entidades comerciais como Prismic, Sentry e InLang”, escreveu a equipe do Svelte.

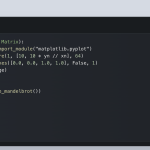

A equipe do Svelte recomenda atualizar primeiro para a versão 1.x mais recente, junto com o Svelte 4, para resolver quaisquer avisos de descontinuação. Em seguida, atualize para o SvelteKit 2 executando a ferramenta de migração automatizada:

npx svelte-migrate sveltekit-2

Pesquisa sobre o estado de ferrugem aberta

O Rust Project abriu sua pesquisa anual sobre ferrugem na segunda-feira e estará em vigor até janeiro. 15. Ele foi projetado para coletar informações sobre o desempenho da comunidade Rust e do desempenho do Projeto Rust. As respostas estão abertas a qualquer pessoa interessada ou usando Rust. As respostas são anônimas, embora seja importante notar que a pesquisa leva de 10 a 25 minutos.

IA na Apple?

Na semana passada, compartilhei como o Google está tornando o Gemini AI acessível para desenvolvedores Android. Parece que os desenvolvedores iOS em breve terão notícias semelhantes. MacRumors está relatando que os pesquisadores de IA da Apple afirmam ter feito um avanço na implantação de grandes modelos de linguagem em dispositivos Apple.

“Os pesquisadores da Apple desenvolveram uma nova técnica que usa memória flash – a mesma memória onde ficam seus aplicativos e fotos – para armazenar os dados do modelo de IA”, informou o site na quinta-feira. O artigo está vinculado a um artigo de pesquisa de engenheiros da Apple que explica como a memória flash pode ser usada para executar IA.

O artigo resume a pesquisa, observando que o armazenamento flash “é mais abundante em dispositivos móveis do que a RAM tradicionalmente usada para executar LLMs”. O método descrito pelos pesquisadores usa duas técnicas para minimizar as transferências de dados e, ao mesmo tempo, maximizar o rendimento da memória flash:

- Windowing, que é quando o modelo de IA reutiliza parte dos dados já processados; e

- Agrupamento de linha e coluna, que agrupa dados para que possam ser lidos mais rapidamente na memória flash.

“A combinação desses métodos permite que os modelos de IA executem até o dobro do tamanho da memória disponível do iPhone”, observou o artigo.

A melhor opção do LangChain para implantação de aplicativos de IA

Para descobrir como os desenvolvedores estão construindo seus aplicativos de IA, LangChain avaliou metadados do LangSmith, uma plataforma em nuvem para construir e testar aplicativos de grandes modelos de linguagem.

Oitenta e cinco por cento dos aplicativos de IA são desenvolvidos usando LangChain. As recuperações são usadas por 42% dos desenvolvedores em aplicativos LLM. É a forma dominante de combinar o tratamento de consultas complexas que envolvem recuperação de dados, de acordo com o estudo. Também descobriu que 17% das consultas complexas fazem parte de um agente. Os agentes permitem que o LLM decida quais etapas tomar, o que permite que o sistema lide melhor com consultas complexas ou casos extremos, embora os agentes pós-notados não sejam superconfiáveis ou de alto desempenho. Isso pode explicar o baixo ponto de adoção dos agentes, acrescentou.

Além disso, o uso da One LangChain Expression Language cresceu rapidamente ao longo deste ano. Introduzido em julho, o uso aumentou rapidamente para 57% em dezembro. LangChain Expression Language “é uma maneira fácil de compor componentes, tornando-a perfeita para criar cadeias complexas e personalizadas”, observou o post.

Não surpreendentemente, o estudo concluiu que a openAI foi classificada como o principal fornecedor de LLM, seguida pela Azure OpenAI. A Anthropic ficou em terceiro lugar e o provedor de código aberto Hugging Face ficou em quarto.

A postagem Dev News: SvelteKit 2.0, State of Rust Survey e AI na Apple apareceu pela primeira vez em The New Stack.