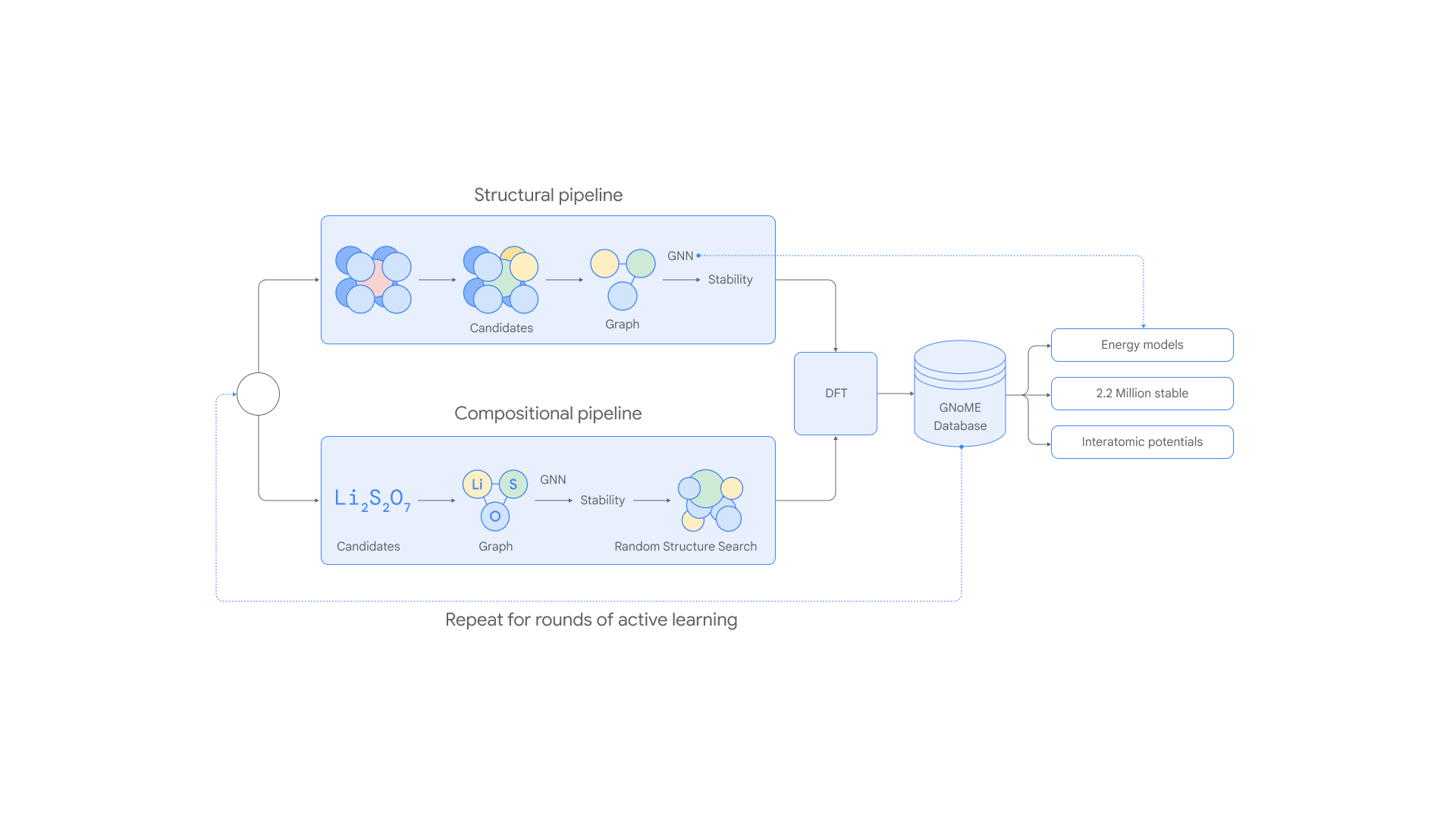

A IA de material do Google DeepMind já descobriu 2,2 milhões de novos cristais

16 de janeiro de 2024

Protect AI levanta US$ 35 milhões para expandir a plataforma de segurança de IA e ML

16 de janeiro de 2024A startup de inteligência artificial (IA) baseada em Nova York, Arthur, anunciou o lançamento do Arthur Bench, uma ferramenta de código aberto para avaliar e comparar o desempenho de grandes modelos de linguagem (LLMs), como o GPT-3.5 Turbo da OpenAI e o LLaMA 2 da Meta.

“Com o Bench, criamos uma ferramenta de código aberto para ajudar as equipes a compreender profundamente as diferenças entre os provedores de LLM, diferentes estratégias de estímulo e aumento e regimes de treinamento personalizados”, disse Adam Wenchel, CEO e cofundador da Arthur, em comunicado à imprensa.

Como funciona o banco Arthur

Arthur Bench permite que as empresas testem o desempenho de diferentes modelos de linguagem em seus casos de uso específicos. Ele fornece métricas para comparar modelos quanto à precisão, legibilidade, cobertura e outros critérios.

Para aqueles que usaram LLMs em mais de algumas ocasiões, “hedging” é um problema especialmente perceptível – é aí que um LLM fornece linguagem estranha resumindo ou aludindo aos seus termos de serviço ou restrições de programação, como dizer “como uma linguagem de IA model…”, o que normalmente não é pertinente à resposta desejada do usuário.

“Essas são algumas das diferenças sutis de comportamento que podem ser relevantes para sua aplicação específica”, disse Wenchel em entrevista exclusiva em vídeo ao VentureBeat.

Arthur incluiu uma série de critérios iniciais para comparar o desempenho do LLM, mas como a ferramenta é de código aberto, as empresas que a utilizam podem adicionar seus próprios critérios para atender às suas necessidades.

“Você pode pegar as últimas 100 perguntas que seus usuários fizeram e compará-las com todos os modelos. Em seguida, Arthur Bench destacará onde as respostas foram totalmente diferentes para que você possa revisá-las manualmente”, explicou Wenchel, acrescentando que o objetivo é ajudar as empresas a tomar decisões informadas ao adotar a IA.

Arthur Bench acelera o benchmarking e traduz medidas acadêmicas em impacto comercial no mundo real. A empresa utiliza uma combinação de medidas e pontuações estatísticas, bem como a avaliação de outros LLMs para avaliar lado a lado a resposta dos LLMs desejados.

Banco Arthur em ação

Wenchel disse que as empresas de serviços financeiros já têm usado o Arthur Bench para gerar teses e análises de investimento mais rapidamente.

Os fabricantes de veículos levaram seus manuais de equipamentos com muitas páginas de orientação técnica altamente específica e usaram o Arthur Bench para criar LLMs que são capazes de responder às dúvidas dos clientes e, ao mesmo tempo, obter informações desses manuais com rapidez e precisão, ao mesmo tempo em que reduzem as alucinações.

Outro cliente, a plataforma de mídia empresarial e publicação Axios HQ, também está usando o Arthur Bench no desenvolvimento de produtos.

“Arthur Bench nos ajudou a desenvolver uma estrutura interna para dimensionar e padronizar a avaliação LLM entre recursos e para descrever o desempenho para a equipe de produto com métricas significativas e interpretáveis”, disse Priyanka Oberoi, cientista de dados da equipe da Axios HQ, em comunicado à VentureBeat.

Arthur é um Bench de código aberto para que qualquer pessoa possa usá-lo e contribuir gratuitamente. A startup acredita que uma abordagem de código aberto leva aos melhores produtos, com oportunidades de monetização por meio de painéis de equipe.

Colaborações com AWS e Cohere

Arthur também anunciou um hackathon com Amazon Web Services (AWS) e Cohere para incentivar os desenvolvedores a construir novas métricas para Arthur Bench.

Wenchel disse que o ambiente Bedrock da AWS para escolher e implantar uma variedade de LLMs estava “muito filosoficamente alinhado” com Arthur Bench.

“Como você decide racionalmente quais LLMs são adequados para você?” Wenchel disse. “Isso complementa muito bem a estratégia da AWS.”

A empresa lançou o Arthur Shield no início deste ano para monitorar grandes modelos de linguagem em busca de alucinações e outros problemas.

Correção, agosto. 17: O autor afirmou erroneamente que Arthur morava em São Francisco. A história foi atualizada e corrigida. Lamentamos o erro.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.