Como a arquitetura RAG supera as limitações do LLM

8 de maio de 2024

3 razões pelas quais os engenheiros de dados são os heróis desconhecidos da GenAI

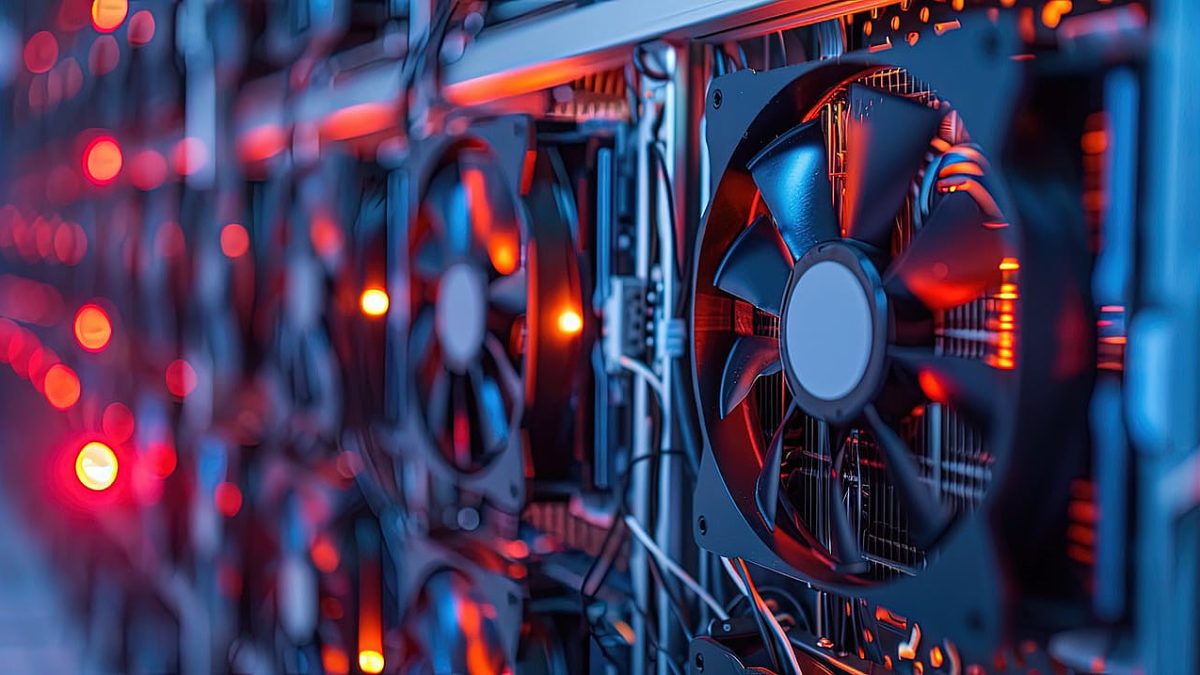

8 de maio de 2024A corrida do ouro da era da IA começou, mas para muitas empresas as picaretas estão em espera. Um fenómeno conhecido como “pobreza de GPU” está a assolar os CIOs à medida que a procura por inteligência artificial dispara, ultrapassando a capacidade de construir centros de dados e, mais importante, os chips necessários para alimentar tudo.

Em suma, a pobreza das GPUs significa que as organizações que gostariam de usar GPUs para computação de IA simplesmente não podem comprar capacidade nestes poderosos sistemas de processamento paralelo, que são a forma mais eficiente de executar muitos tipos de aprendizagem automática.

Essa escassez tem suas raízes na tempestade perfeita das tempestades perfeitas. A escassez global de chips com unidades de processamento gráfico poderosas levou as startups a arrecadar dinheiro especificamente para comprar GPUs – uma tática insana quando se considera que enormes gastos de capital antes das receitas são exatamente o problema que a computação em nuvem resolve. Depois, há as demandas cada vez maiores de cargas de trabalho de IA.

À medida que mais e mais empresas procuram aproveitar os serviços de IA de empresas como OpenAI e Google ou explorar modelos e cadeias de ferramentas de IA na nuvem, elas aumentam a pressão sobre os preços das GPUs – colocando as GPUs ainda mais fora do alcance de startups e outras organizações. falta de capital.

A pobreza da GPU está se espalhando por toda a cadeia de suprimentos e por todo o conjunto de ferramentas dos construtores de IA. As empresas de construção de data centers enfrentam atrasos de vários anos em componentes essenciais demandados, como geradores de backup e transformadores elétricos. Até mesmo encontrar locais adequados com imóveis baratos, energia barata e abundante e conectividade rápida à Internet global tornou-se muito mais assustador.

Depois, há a questão dos chips perdidos. As fábricas de semicondutores estão lutando para acompanhar e seus esforços para construir rapidamente novas fábricas só darão frutos ao longo de muitos anos.

Enquanto isso, os provedores de nuvem em hiperescala e as grandes empresas estão engolindo a oferta limitada de produção de GPU, elevando os preços às alturas. Para muitas empresas, especialmente aquelas sem orçamentos ilimitados, as dificuldades de acesso a GPUs na nuvem para aplicações de IA estão se tornando um risco comercial significativo.

Os CIOs inteligentes, no entanto, podem aliviar a insanidade da GPU com medidas de bom senso para reduzir os requisitos de recursos para executar a IA nas suas empresas.

Use modelos frugais e inferência

Assim como um viajante engenhoso aprende a levar pouca bagagem, os cientistas de dados podem obter resultados surpreendentes com modelos de IA menores e mais eficientes. Por exemplo, o modelo Phi-2 da Microsoft, que foi treinado em livros didáticos e dados de altíssima qualidade, é compacto e eficiente em termos de recursos, exigindo muito menos computação para ajuste e inferência.

Técnicas mais recentes, como quantização e poda, estão permitindo que os pesquisadores reduzam modelos gigantescos sem sacrificar a precisão. Estruturas como o TensorFlow Lite são projetadas especificamente para implantar esses modelos mais enxutos em dispositivos de ponta, e startups como a Hugging Face estão democratizando o acesso a modelos eficientes e pré-treinados. A equipe responsável pela estrutura PyTorch também está criando novas maneiras de treinar modelos de forma eficaz, com menos dados e sobrecarga.

Otimize tudo

Com os preços estratosféricos do tempo de GPU, a otimização das cargas de trabalho de IA compensa rapidamente e bem. As equipes de engenharia de IA e MLOps devem traçar o perfil de desempenho de forma agressiva e frequente para identificar gargalos. Isso pode significar comparar diferentes configurações (tamanhos de lote, número de GPUs) para encontrar a configuração mais eficiente para sua tarefa específica, porque nem sempre é simples.

Equipes experientes combinarão e ajustarão a precisão dos dados (FP16, FP32, etc.) durante o treinamento para reduzir o uso de memória e executar lotes maiores. Gerenciar a alocação de memória e movimentos de dados com técnicas como pré-busca de dados e transferências de dados cronometradas para acompanhar de perto a disponibilidade da computação pode ajudar.

Encontrar o tamanho de lote ideal para trabalhos de IA é crucial. Um tamanho de lote maior pode utilizar melhor a GPU, mas muito grande pode levar a erros de falta de memória. Experimente encontrar o ponto ideal. Experimente o software de virtualização de GPU se você tiver GPUs maiores ou tiver reservado muita capacidade de GPU. Isso pode permitir que você reaproveite cálculos valiosos e raros necessários para modelos de treinamento ou faça ajustes maiores para lidar com inferências de modelos mais comuns necessárias para operações de aplicativos de IA.

Por fim, implemente com base em contêineres que permitam o escalonamento automático, se possível, para ajustar dinamicamente o número de GPUs alocadas a uma carga de trabalho com base nas necessidades em tempo real. Isso ajuda a evitar o provisionamento excessivo e, ao mesmo tempo, garante recursos suficientes para períodos de pico.

Ajuste o balanceamento de carga para IA

O balanceamento de carga adequadamente ajustado enfrenta o desafio da pobreza da GPU, ao mesmo tempo que garante que os trabalhos de IA recebam os recursos necessários sem intervalos e oferecendo segurança aprimorada. Ele difere do balanceamento de carga tradicional por reconhecer os diversos requisitos computacionais das tarefas de IA.

Ao criar perfis de cargas de trabalho, avaliar suas necessidades de CPU e GPU e priorizar operações urgentes, os balanceadores de carga específicos de IA distribuem dinamicamente o trabalho pelo hardware mais adequado. Essa abordagem protege suas GPUs caras para operações que realmente exigem seus recursos, ao mesmo tempo que transfere o trabalho vinculado à CPU para recursos mais econômicos.

Fundamentalmente, o balanceamento de carga específico de IA introduz uma nova dimensão de controle com gerenciamento de tokens. Em sistemas de IA onde os tokens desempenham um papel (modelos de linguagem), o balanceamento de cargas não envolve apenas a eficiência do hardware. Os balanceadores de carga podem monitorar o uso de tokens associados a trabalhos de IA, redirecionando solicitações dinamicamente para otimizar o consumo de tokens e evitar custos excessivos.

Além disso, ao encaminhar trabalhos de forma inteligente com base nas possíveis implicações de segurança e sensibilidades dos tokens, os balanceadores de carga de IA ajudam a isolar cargas de trabalho de alto risco, fornecendo uma camada adicional de proteção para seus sistemas de IA. A implementação de tal estratégia de balanceamento de carga exige uma consideração cuidadosa da integração da estrutura, monitoramento robusto e possíveis economias de custos com soluções de balanceamento de carga de IA baseadas em nuvem.

Os balanceadores de carga ajustados por IA podem fornecer controle mais granular – limitação de taxa baseada em token, por exemplo, e algoritmos que enviam ou transferem trabalhos para clusters LLM que são os mais econômicos em termos de uso ou custos de token.

O futuro é (espero) abundante

A boa notícia é que a indústria não está parada. Os fabricantes de chips estão aumentando a produção e novas arquiteturas de chips projetadas especificamente para IA estão no horizonte. Mais data centers de IA ficarão online. Muitos desenvolvedores inteligentes e equipes de engenharia estão melhorando continuamente a forma como os modelos de IA funcionam e reduzindo a carga de treinamento dos modelos, ao mesmo tempo em que mantêm a linha ou até mesmo melhoram o desempenho.

No entanto, estas soluções não chegarão da noite para o dia. Entretanto, ao adoptarem uma mentalidade de modelo em primeiro lugar, optimizando a utilização e exercendo o equilíbrio de carga estrategicamente, os CIOs podem mitigar os piores excessos da actual bolha de infra-estruturas e evitar a pobreza da GPU, garantindo que as suas organizações tenham IA suficiente para os trabalhos que precisam de ser realizados. feito.

A postagem Como os CIOs podem combater a pobreza da GPU na era da IA apareceu pela primeira vez no The New Stack.