Previsões de IA para 2024: o que pensam os principais VCs

12 de janeiro de 2024

Snowflake compra fabricante de salas limpas de dados Samooha

12 de janeiro de 2024Junte-se aos líderes em São Francisco no dia 10 de janeiro para uma noite exclusiva de networking, insights e conversas. Solicite um convite aqui.

Quando o ChatGPT foi lançado, há mais de um ano, os usuários da Internet tinham um assistente de IA sempre disponível para conversar e trabalhar. Ele cuidava de suas tarefas diárias, desde a produção de conteúdo em linguagem natural (como ensaios) até a revisão e análise de informações complexas. Em pouco tempo, a ascensão meteórica do chatbot chamou a atenção do mundo para a tecnologia que está em seu cerne: a série GPT de grandes modelos de linguagem (LLMs).

Avançando até os dias atuais, os LLMs – a série GPT e outros – são a força motriz não apenas de tarefas específicas individuais, mas também de operações comerciais massivas. As empresas estão aproveitando APIs de modelo comercial e ofertas de código aberto para automatizar tarefas repetitivas e aumentar a eficiência em funções importantes. Imagine conversar com IA para gerar campanhas publicitárias para equipes de marketing ou ser capaz de acelerar as operações de suporte ao cliente exibindo o banco de dados certo no momento certo.

O impacto foi profundo. No entanto, uma área onde o papel dos LLMs não é tão discutido é a pilha de dados moderna.

LLMs transformando a pilha de dados

Os dados são a chave para modelos de linguagem grande e de alto desempenho. Quando esses modelos são treinados corretamente, eles podem ajudar as equipes a trabalhar com seus dados, seja fazendo experiências ou executando análises complexas.

Evento VB

O tour de impacto da IA

Chegando a um plano de governança de IA – Solicite um convite para o evento de 10 de janeiro.

Saber mais

Na verdade, durante o último ano, à medida que o ChatGPT e as ferramentas concorrentes cresceram, as empresas que fornecem ferramentas de dados às empresas incluíram IA generativa nos seus fluxos de trabalho para facilitar as coisas aos seus clientes. A ideia era simples: aproveitar o poder dos modelos de linguagem para que os clientes finais não apenas obtivessem uma experiência melhor ao lidar com dados, mas também pudessem economizar tempo e recursos – o que acabaria por ajudá-los a se concentrar em outras tarefas mais urgentes.

A primeira (e provavelmente a mais importante) mudança com os LLMs ocorreu quando os fornecedores começaram a lançar recursos de consulta conversacional – ou seja, obter respostas de dados estruturados (dados ajustados em linhas e colunas) conversando com eles. Isso eliminou o incômodo de escrever consultas SQL (linguagem de consulta estruturada) complexas e proporcionou às equipes, incluindo usuários não técnicos, uma experiência de texto para SQL fácil de usar, onde poderiam inserir prompts em linguagem natural e obter insights de seus dados. O LLM usado converteu o texto em SQL e, em seguida, executou a consulta no conjunto de dados de destino para gerar respostas.

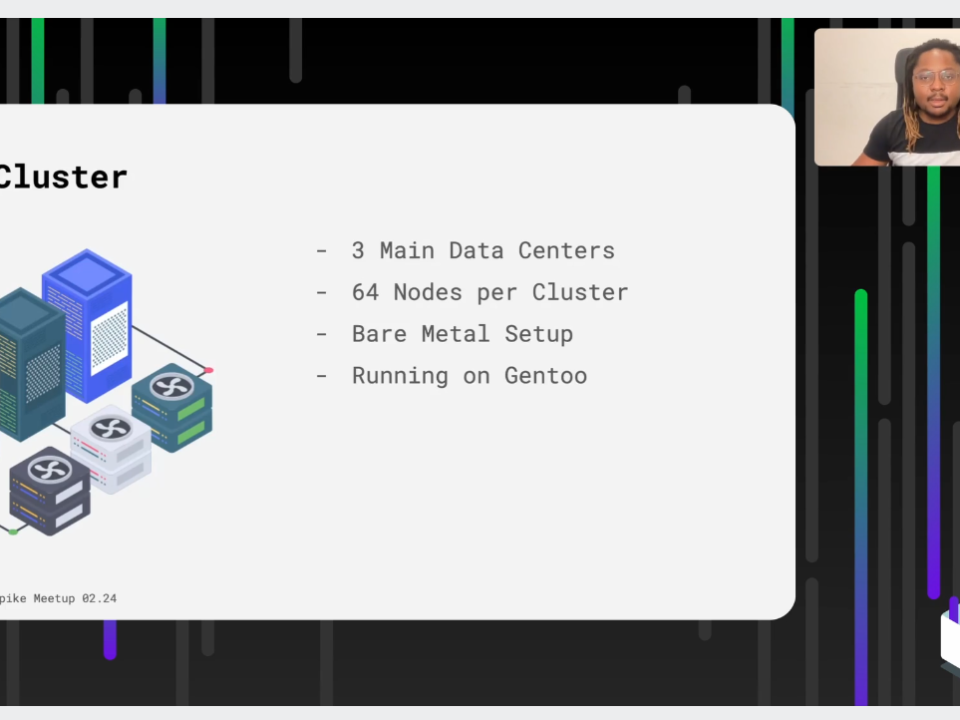

Embora muitos fornecedores tenham lançado esse recurso, alguns dos mais notáveis que entraram no mercado foram Databricks, Snowflake, Dremio, Kinetica e ThoughtSpot. Kinetica inicialmente utilizou o ChatGPT para a tarefa, mas agora usa seu próprio LLM nativo. Enquanto isso, Snowflake oferece duas ferramentas. Um, um copiloto que funciona como assistente de conversação para coisas como fazer perguntas sobre dados em texto simples, escrever consultas SQL, refinar consultas e filtrar insights. A segunda é uma ferramenta Document AI para extrair informações relevantes de conjuntos de dados não estruturados, como imagens e PDFs. A Databricks também atua neste espaço com o que chama de ‘LakehouseIQ’.

Notavelmente, várias startups também surgiram na mesma área, visando o domínio analítico baseado em IA. A DataGPT, com sede na Califórnia, por exemplo, vende um analista de IA dedicado para empresas, que executa milhares de consultas no cache relâmpago de seu armazenamento de dados e obtém resultados em tom coloquial.

Ajudando no gerenciamento de dados e nos esforços de IA

Além de ajudar as equipes a gerar insights e respostas a partir de seus dados por meio de entradas de texto, os LLMs também lidam com o gerenciamento de dados tradicionalmente manual e com os esforços de dados cruciais para a construção de um produto de IA robusto.

Em maio, a Informatica, fornecedora de Intelligent Data Management Cloud (IDMC), estreou Claire GPT, uma ferramenta de IA conversacional baseada em multi-LLM que permite aos usuários descobrir, interagir e gerenciar seus ativos de dados IDMC com entradas de linguagem natural. Ele lida com vários trabalhos na plataforma IDMC, incluindo descoberta de dados, criação e edição de pipeline de dados, exploração de metadados, exploração de qualidade de dados e relacionamentos e geração de regras de qualidade de dados.

Então, para ajudar as equipes a criar ofertas de IA, a Refuel AI, com sede na Califórnia, fornece um grande modelo de linguagem desenvolvido especificamente que ajuda na rotulagem de dados e nas tarefas de enriquecimento. Um artigo publicado em outubro de 2023 também mostra que os LLMs podem fazer um bom trabalho na remoção de ruído dos conjuntos de dados, o que também é um passo crucial na construção de uma IA robusta.

Outras áreas da engenharia de dados onde os LLMs podem entrar em ação são a integração e orquestração de dados. Os modelos podem essencialmente gerar o código necessário para ambos os aspectos, seja para converter diversos tipos de dados em um formato comum, conectar-se a diferentes fontes de dados ou consultar modelos de código YAML ou Python para construir DAGs do Airflow.

Muito mais por vir

A Monte Carlo, conhecida fornecedora da categoria, já lançou o Fix with AI, ferramenta que detecta problemas no pipeline de dados e sugere o código para corrigi-los. A Acceldata, outro player no setor, também adquiriu recentemente a Bewgle para se concentrar na integração LLM para observabilidade de dados.

No entanto, à medida que essas aplicações surgem, também se tornará mais importante do que nunca para as equipes garantirem que esses modelos de linguagem, sejam eles construídos do zero ou ajustados, tenham o desempenho correto. Um pequeno erro aqui ou ali e o resultado posterior podem ser afetados, levando a uma experiência do cliente prejudicada.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.