Por que Capistrano foi usurpado pelo Docker e depois pelo Kubernetes

24 de janeiro de 2024

AppMap lança revisão de código em tempo de execução como uma ação do GitHub

24 de janeiro de 2024Imagine isto: você entra em uma loja Macy’s, fazendo uma pausa no mundo virtual para se entregar à experiência tátil das compras físicas.

Ao entrar, um Android alto e de ombros largos chamado Friday o cumprimenta calorosamente.

“Bem-vinda de volta, Lúcia. Como você está hoje? Você gostou do suéter rosa que comprou na semana passada?”

Surpreso com o toque pessoal, você responde: “Estou bem, obrigado. Na verdade, estou procurando uma blusa para combinar com esse suéter.”

Friday envolve você em uma conversa, perguntando sutilmente sobre suas preferências, até que, finalmente, o espelho inteligente embutido em seu torso se acende. Ele examina seu corpo e sobrepõe opções de roupas selecionadas em seu avatar. Impressionado?

Agora, com um aceno de cabeça, um dos lacaios de sexta-feira recupera o traje escolhido e alguns acessórios combinando e leva você ao próximo camarim disponível.

A ficção científica sonha (nem sempre positivamente) com esse tipo de coisa há décadas – você acredita que o Minority Report foi lançado há mais de 20 anos?

Mas finalmente o futuro está aqui. Esta é a realidade em evolução no retalho, na saúde, na agricultura e numa vasta gama de outros setores, graças à rápida maturação da inteligência artificial (IA). Desde carros autônomos e outros veículos autônomos até robôs coletores de frutas e diagnósticos de imagens médicas de IA, a IA está agora verdadeiramente em toda parte.

Spectro Cloud permite exclusivamente que as organizações gerenciem Kubernetes em produção, em escala. Nossa plataforma de gerenciamento Palette oferece controle fácil de todo o ciclo de vida do Kubernetes, em nuvens, data centers, ambientes bare metal e edge.

Saber mais

As últimas novidades do Spectro Cloud

$(document).ready(function() { $.ajax({ método: ‘POST’, url: ‘/no-cache/sponsors-rss-block/’, headers: { ‘Cache-Control’: ‘no- cache, no-store, must-revalidate’, ‘Pragma’: ‘no-cache’, ‘Expires’: ‘0’ }, dados: { patrocinadorSlug: ‘spectro-cloud’, numItems: 3 }, sucesso: function( dados) { if (data.startsWith(‘ERROR’)) { console.log(data); $(‘.sponsor-note-rss’).hide(); } else { $(‘.sponsor-note-rss -items-spectro-cloud’).html(dados); } } }); });

IA: a magia por trás da cortina

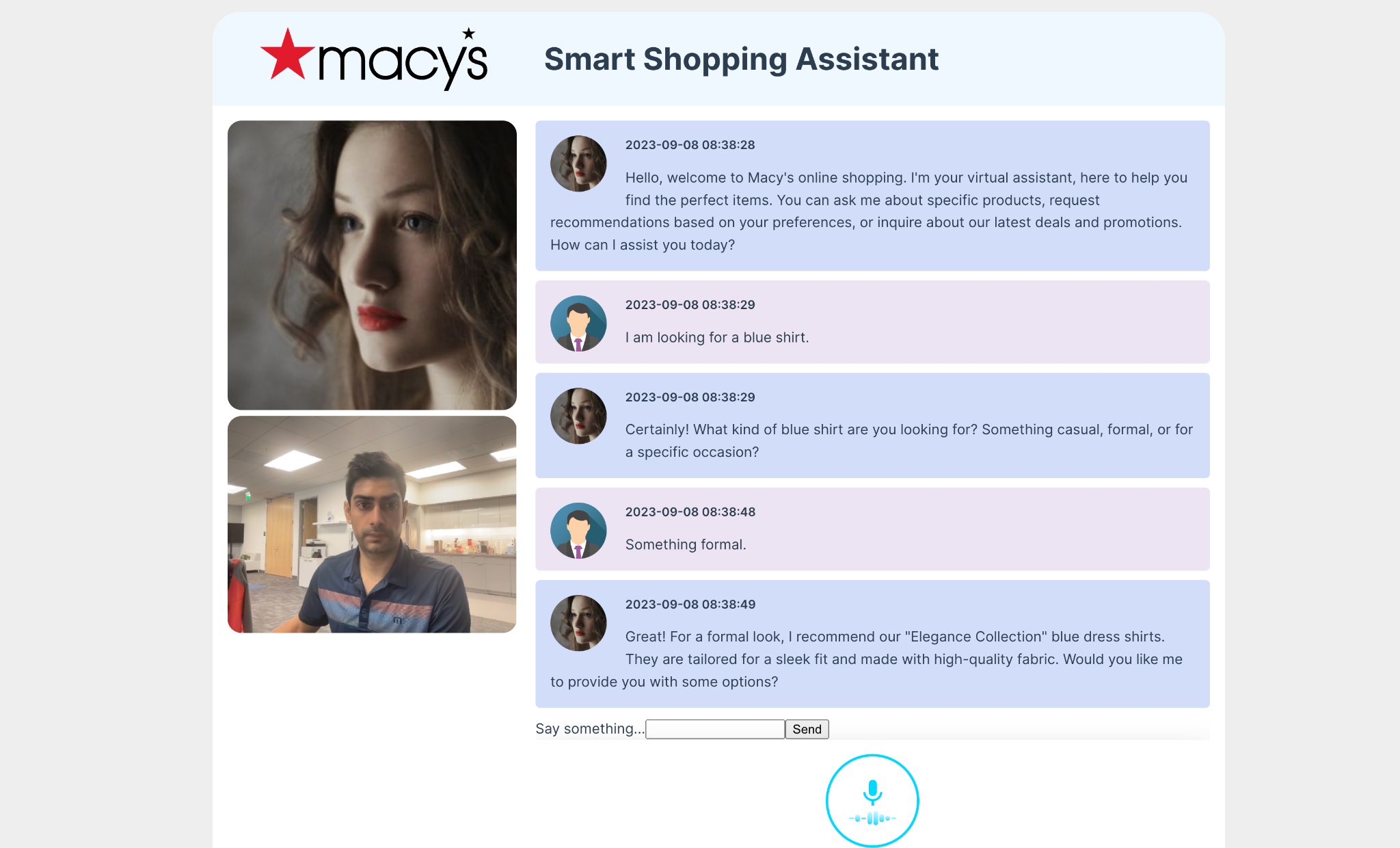

Por mais encantadora que pareça a experiência do cliente no nosso cenário Macy’s, a orquestração tecnológica por trás dela não é menos impressionante.

Quando dizemos “IA” estamos provavelmente a falar da integração perfeita de tantas tecnologias diferentes:

- Conversão de texto para fala (TTS)para converter o roteiro e os nomes dos produtos de sexta-feira em áudio falado.

- Conversão de fala para texto (STT)para reconhecer suas respostas e armazená-las.

- detecção de objetos, para reconhecer roupas e clientes.

- processamento de linguagem natural, para extrair significado de suas respostas faladas.

- Geração de imagem para criar roupas de amostra a partir de instruções.

E, claro, por trás de tudo isso, um banco de dados vetorizado e atualizado de mercadorias disponíveis na loja e registros de clientes.

Quando eu disse que a IA está amadurecendo rapidamente, não estava brincando. Esses recursos complexos estão agora realmente ao alcance de todas as empresas, inclusive a sua, graças a um cenário florescente de tecnologias de código aberto e produtos SaaS simples.

Recentemente criei uma demonstração que imita essa experiência de compra pessoal interativa. Ainda não é sexta-feira e não está no corpo do Android – mas está no seu navegador para você experimentar aqui mesmo.

A propósito: como alguém que não codifica tanto quanto antes, ainda consegui implementar toda essa pilha em menos de um dia, e na maior parte do tempo estava lutando com CSS para fazer cantos arredondados! As porções reais de TTS, STT e LLM foram relativamente fáceis, usando as incríveis APIs OpenAI.

É claro que, no mundo real, eu provavelmente não gostaria de enviar meus dados corporativos para as entranhas do OpenAI, e é por isso que recomendo fortemente que você confira nosso projeto LocalAI de código aberto, que permite executar tudo em -prem.

O verdadeiro lar da IA está no limite

Hoje, o treinamento e o aprendizado profundo de modelos acontecem com enormes custos em nuvens e data centers, porque exigem muito uso computacional. Muitos dos principais processamentos e serviços mencionados acima são executados em serviços em nuvem, onde podem ser facilmente dimensionados e gerenciados.

Mas para o trabalho real de inferência crítica para os negócios no mundo real, os assistentes de varejo e outras cargas de trabalho de IA provavelmente não deveriam viver na nuvem. Eles precisam viver no limite. Na verdade, acreditamos que o lar natural para maioria As cargas de trabalho de IA serão executadas na borda da rede.

Por que? A computação distribuída coloca o poder de processamento e os recursos computacionais mais próximos do usuário e do processo de negócios. Ele evita vários desafios importantes:

- Conectividade: As cargas de trabalho de IA podem envolver uma enorme quantidade de dados. No entanto, especialmente em casos de utilização rural ou industrial, as ligações à Internet em locais periféricos são frequentemente intermitentes ou lentas, representando um grande estrangulamento. E os lançamentos do 5G não resolverão isso tão cedo. Se você processar os dados no dispositivo, não precisará se conectar à Internet.

- Latência: Mesmo se você tiver conectividade com o DC ou com a nuvem, a latência se torna um fator. Algumas centenas de milissegundos podem não parecer muito, mas numa interação em tempo real, é uma eternidade. A execução de cargas de trabalho de IA na borda permite experiências em tempo real com tempos de resposta quase instantâneos.

- Custos da nuvem: Os hiperscaladores cobram para ingerir seus dados, movê-los entre zonas de disponibilidade e extraí-los novamente. Em milhões de interações de IA, esses custos aumentam.

- Dados privados: Muitas cargas de trabalho de IA coletarão dados regulamentados e confidenciais. Você realmente quer que suas medidas corporais e histórico de compras flutuem na nuvem? Com a computação de ponta, seus dados pessoais confidenciais são processados localmente, no servidor de ponta, e é onde eles podem ficar, se a conformidade exigir.

Mas Edge apresenta seus próprios desafios…

Qualquer pessoa que já tenha tentado implantar infraestrutura de computação de ponta em escala, seja no Kubernetes ou em outra plataforma, dirá que é um trabalho árduo.

Você enfrentará desafios relacionados à implantação e integração de hardware continuamente. Como você pode inicializar e ativar seu Android de sexta-feira quando não há nenhum especialista em TI na loja para executar a CLI?

Você deve abordar a segurança, quando os dispositivos podem estar vulneráveis a adulterações físicas. No mínimo, você precisa considerar a criptografia e um meio de verificar a confiança do dispositivo, na inicialização e além.

E você precisa gerenciar pilhas de hardware e software em escala, desde o monitoramento até a aplicação de patches. Isso por si só é um grande desafio quando se consideram as limitações de hardware de dispositivos de borda de fator de forma pequeno e a conectividade intermitente entre o dispositivo e a infraestrutura de gerenciamento na sede. Você precisa de uma arquitetura com atualizações sem risco e com capacidade de execução eficaz em um ambiente air-gap.

…e a IA amplifica os desafios do Edge

Adicionar IA a ambientes de borda introduz novas camadas de complexidade. Não é apenas a infraestrutura que você precisa gerenciar agora, mas também:

Modelos: seus cientistas de dados têm um número impressionante de conjuntos de dados e modelos prontos para escolher em repositórios populares como o Hugging Face. Como você pode ajudá-los a testar e implantar rapidamente esses modelos e, em seguida, mantê-los atualizados diariamente ou semanalmente?

Motores de IA: Motores como Seldon, BentoML e Kserve precisam de manutenção, atualizações e ajustes constantes para obter desempenho ideal. Atualizá-los em vários locais torna-se tedioso e sujeito a erros.

Os modelos de IA processam os dados recebidos em tempo real, transformando entradas brutas, como comandos de voz ou leituras de sensores, em insights acionáveis ou interações personalizadas. Mecanismos de IA como Seldon, BendoML e Kserve executam esses modelos de IA. Pense assim: os modelos de IA são cargas de trabalho e o mecanismo de IA é o tempo de execução em que esses modelos são executados.

Resolvendo os desafios do Edge para suas cargas de trabalho de IA

Este é o espaço problemático que temos atacado enquanto construímos o Palette EdgeAI, anunciado hoje.

O Palette EdgeAI ajuda você a implantar e gerenciar a pilha completa, desde o sistema operacional de borda e a infraestrutura Kubernetes até os modelos que alimentam seus aplicativos inovadores de IA.

Sem se aprofundar muito na lista de recursos, o EdgeAI permite:

- Implante e gerencie suas pilhas de IA de borda em locais de borda em escala, desde opções fáceis de integração de hardware até ‘projetos’ repetíveis que incluem o mecanismo de IA escolhido.

- Atualize seus modelos de borda com frequência sem risco de tempo de inatividade, com fácil integração de repositório e atualizações e reversões seguras e controladas por versão.

- Proteja propriedade intelectual crítica e dados confidenciais, com uma arquitetura de segurança completa, do silício ao aplicativo, incluindo imutabilidade, inicialização segura, varreduras SBOM e modo air-gap.

A integração da IA e da computação de ponta não é apenas uma possibilidade intrigante; é uma necessidade para o próximo salto em tecnologia e experiência do usuário. À medida que nos posicionamos nesta fronteira emocionante, uma coisa é clara: o futuro das compras, dos cuidados de saúde, dos negócios e de muitos outros aspectos da vida será mais inteligente, mais rápido e mais personalizado do que nunca.

Também existem casos de uso de IA de ponta para o seu setor. As previsões de crescimento são estratosféricas: o mercado global de software Edge AI deverá crescer de US$ 590 milhões em 2020 para US$ 1,83 trilhão até 2026, de acordo com a MarketsandMarkets Research.

Pronto para fazer parte deste futuro? Claro que você é. Mas os benefícios da IA só estarão ao seu alcance se você conseguir enfrentar os desafios da borda. É aí que podemos ajudar. Então por que não dar uma olhada no Palette EdgeAI e nos contar o que você pensa?

A postagem Edge AI: como fazer a mágica acontecer com Kubernetes apareceu pela primeira vez em The New Stack.