ScaleOps dimensiona contêineres dinamicamente corretamente em tempo de execução

23 de janeiro de 2024

Melhore a velocidade do desenvolvedor descentralizando os testes

23 de janeiro de 2024Durante o último ano, muitos projetos de grandes modelos de linguagem (LLM) surgiram rapidamente das profundezas da pesquisa. Olhar para o próximo ano tem menos a ver com seguir tendências e mais com identificar quais periscópios serão levantados primeiro. Nem tudo será sobre ou em torno da IA, mas pelo menos por mais um ano, os suspeitos do costume ganharão as manchetes.

Listei as áreas que podem afetar os desenvolvedores por meio do envolvimento ou do uso do serviço em seus próximos projetos. A maioria destas são apenas as próximas áreas problemáticas ou onde os interesses colidem naturalmente.

Aceleração, redução e geração automática de dados por IA

Entramos agora no período da IA de “deixar mil LLMs florescerem”, e os problemas de acesso aos dados e as limitações de tamanho de muitas operações menores também florescerão.

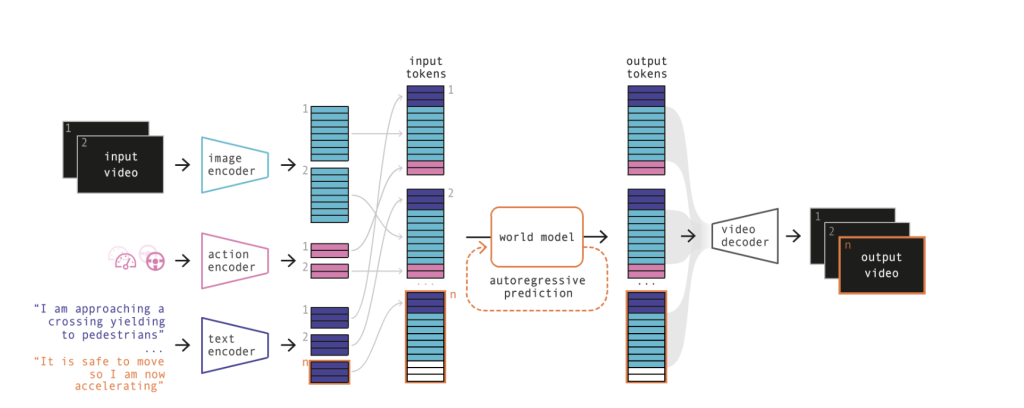

A solução para a direção autônoma que a Wayve está adotando é alimentar um modelo com informações visuais, que pode então gerar vídeos de direção, que podem ser usados como dados de treinamento ou previsão. Isso faz sentido porque mesmo com câmeras de painel, provavelmente não há feed de vídeo suficiente para aprendizado profundo. Mas essas coisas exigem muita computação.

Em vez de usar palavras como tokens, o sistema de Wayves usa imagens como tokens de entrada e, assim como prever a próxima palavra, aqui o sistema prevê a próxima imagem.

Como o diagrama sugere, o sistema analisa a entrada visual (image encoder) e o que o carro está fazendo (action encoder) para ajudar a prever a próxima etapa por meio do interno world model:

Aquilo é uma galinha atravessando a rua?

Usar modelos menores e mais eficientes é a única maneira de sair de uma guerra crescente de tamanhos, que outra escassez de chips poderia exacerbar. O outro ângulo é, obviamente, colocar modelos menores em dispositivos móveis. Portanto, espere que o trabalho continue nesta área.

Mais aplicativos que disponibilizam seus próprios dados para IA

Se você se lembrar da tendência do “eu quantificado” de alguns anos atrás, verá por que a IA liberada em seus dados pessoais pode ser valiosa. Isso pode não ser mais do que conectar uma interface de bate-papo ao seu diário, mas provavelmente apresentará colaborações mais inteligentes nas áreas de saúde e registro de vida.

Para poder fazer perguntas ao seu monitor de sono, como “Quanto sono a mais eu dormi este mês, em comparação com o mês passado?” poderia realmente ajudá-lo a fazer melhores escolhas de vida sem ter que olhar para gráficos. Consultas mais específicas, como “Quais das minhas rotas de deslocamento serão menos afetadas pelas obras nas estradas?” é a melhor maneira de manter as soluções centradas no que você precisa, em vez de mudar de ambiente.

Esta é uma oferta muito mais fácil para empresas que já possuem seus dados. Em alguns casos, a tendência ChatGPT é uma ótima maneira de expor discretamente o fato de que eles já podem fazer isso, e poderão fazê-lo por algum tempo.

Agentes autônomos ainda atingirão a barreira de segurança e privacidade

A palavra “agente” é usada em demasia na computação de IA. Aqui eu uso isso para significar programas que usam LLMs para entender metas, gerar tarefas e tentar concluí-las.

Mas os problemas que enfrentam são os mesmos dos anos de dados federados: como um agente controlado por mim consegue permissão para usar os dados de outra pessoa?

Não creio que os agentes avancem significativamente, porque os seus limites legais e de segurança não foram definidos. Mais especificamente, por mais que eu respeite as empresas que trabalham arduamente para alavancar os LLMs, elas parecem claramente desinteressadas nas estruturas legais

Isto pode significar que existe um nicho de oportunidade para resolver este problema, mas a experiência diz-me que ainda não é do interesse de ninguém resolver isto. Mais uma vez, é melhor possuir ou roubar o máximo de dados possível. Voltaremos a isso mais tarde.

IA ajudando a permitir o monitoramento em tempo real na borda

Um dos escândalos que atingiu recentemente o Reino Unido foram as descargas ilegais de esgoto bruto nos rios da Grã-Bretanha por empresas de água desonestas. Não é necessário qualquer equipamento sofisticado para detectar este ataque nocivo, mas o interesse na monitorização em tempo real da qualidade da água dos rios aumentou claramente.

O mesmo se aplica à medição da luz solar para painéis solares, à poluição atmosférica das cidades e aos volumes de tráfego em todo o mundo, etc., uma vez que nos preocupamos com o controlo e a eficiência do carbono.

Os tipos mais tradicionais de sistemas especialistas podem ajudar a filtrar esses dados, mas usar o aprendizado de máquina para obter insights de forma autônoma ou alterar parâmetros de detecção pode ajudar a enfrentar os problemas. Isto também impulsiona o aumento de gêmeos digitais, que podem detectar e reagir ao ambiente em tempo real.

Edge Computing e colocação de cargas de trabalho em lugares diferentes

Um tanto ligado a dois pontos anteriores, colocar a computação mais próxima dos dados processados, permitindo assim que os cálculos sejam feitos onde os dados são realmente coletados, é uma daquelas economias de eficiência que podem começar a ser bastante importantes no estabelecimento da “IA de ponta”.

Esta pode ser a chave para permitir melhores respostas às consultas móveis. Implica modelos de aprendizado de máquina menores e mais compactos, que podem consumir menos energia, reduzir a latência e, de alguma forma, minimizar a largura de banda.

Se você está se perguntando se isso aumenta a superfície de ataque para hackers – bem, sim, aumenta. Portanto, os riscos de segurança têm de ser cuidadosamente integrados nestas plataformas integradas.

Mais trabalho para o diretor de dados

De repente, os dados da sua organização não têm simplesmente uma importância estratégica vaga; agora pode estar alimentando LLMs sem permissão. Independentemente do que você pense de Elon Musk, sua lógica geralmente distorcida em relação às decisões sobre como administrar plataformas de mídia social estava correta neste ponto. E outros estão descobrindo isso também.

O diretor de dados (ou equivalente) precisa agora trabalhar numa estratégia de luta ou fuga, e não apenas em mais uma jogada no ecossistema. Antes que possam pensar em tornar os dados de seus clientes mais valiosos, eles precisam ter certeza de que eles não estão desaparecendo, como mencionei acima. Isto envolverá o bloqueio ou a oferta de serviços concorrentes. Eventualmente, haverá recurso legal, mas isso chegará tarde demais para a maioria das organizações menores.

O resultado final é que um LLM usará seus dados valiosos. Portanto, pode muito bem ser um LLM sob seu controle.

Os Doomsayers cedem

Como os produtos reais da IA não conseguem corresponder ao hype, uma coisa boa será a desaceleração do circo do risco existencial. Tentar despertar o interesse da mídia dizendo o quão perigoso algo é me lembra crianças em um parquinho, e não um esforço sério para beneficiar a humanidade.

Tal como os Golgafrinchams, é ainda mais provável que a extinção humana seja causada por uma praga contraída por telefones sujos, como observou Douglas Adams na sua ficção. E com isso desejo um Feliz Ano Novo.

A postagem Engenharia de IA: o que os desenvolvedores precisam pensar em 2024 apareceu pela primeira vez no The New Stack.