Melhor, mais rápido, mais forte: como a IA generativa transforma o desenvolvimento de software

20 de fevereiro de 2024

Testando arquiteturas orientadas a eventos com OpenTelemetry

21 de fevereiro de 2024Hoje o Google está anunciando dois novos modelos de IA: Gemma 2B e Gemma 7B. Cada um dos modelos é lançado “com variantes pré-treinadas e ajustadas às instruções”.

Em uma coletiva de imprensa, Tris Warkentin, diretor do Google DeepMind, descreveu os novos modelos como “uma nova família de modelos menores de última geração, que permitirá aos desenvolvedores fazer pesquisas e desenvolvimento de IA na esfera aberta com ferramentas baseadas fora da pesquisa e das tecnologias que também usamos para construir o Gemini.”

Além disso, o Google está lançando um novo “Responsible Generative AI Toolkit”, que fornece orientação e ferramentas para “criar aplicativos de IA mais seguros com Gemma”.

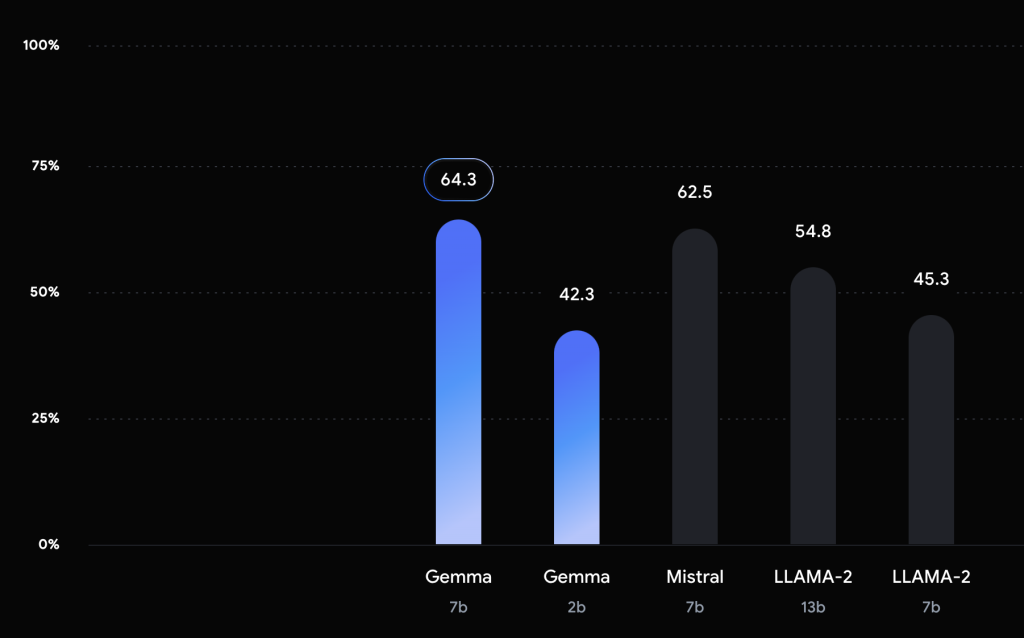

Segundo o Google, Gemma já supera Llama 2 e Mistral da Meta em testes de benchmark. “Estamos fazendo parceria com a Nvidia e a Hugging Face e, portanto, eles (os benchmarks) serão incorporados na tabela de classificação aberta do LLM desde o dia zero”, disse Warkentin.

Gemma vs Llama 2 e Mistral (de acordo com o Google)

Quão aberta é Gemma?

O que o Google quer dizer com “aberto” neste caso? Jeanine Banks, vice-presidente e gerente geral de Developer X e DevRel do Google, esclareceu que sim não significa código aberto.

“Este termo (aberto) tornou-se bastante difundido agora na indústria e muitas vezes se refere a modelos de pesos abertos, onde há amplo acesso para desenvolvedores e pesquisadores personalizarem e ajustarem modelos”, disse ela. “Mas, ao mesmo tempo, os Termos de Uso, como redistribuição e propriedade das variantes desenvolvidas, variam com base nos próprios termos de uso específicos do modelo. E então vimos alguma diferença entre o que tradicionalmente chamaríamos de código aberto e decidimos que fazia mais sentido nos referirmos aos nossos modelos gerais como modelos abertos.”

Mais tarde no briefing, foi perguntado a Banks se os modelos Gemma podem ser utilizados comercialmente – ou estão restritos a atividades de investigação e desenvolvimento? Ela respondeu que o Google está fornecendo uma “licença comercialmente permissiva” para Gemma.

“Portanto, você não verá nenhuma restrição sobre os tipos de organizações que podem usar isso, ou qualquer que seja o tamanho dessas organizações, ou quantos usuários elas possam ter para seus produtos”, disse ela. “Portanto, é comercialmente permissivo. No entanto, queremos adotar uma abordagem responsável. E então temos termos que realmente restringem a promoção de danos ao usar esses modelos.”

Ela acrescentou que o Google monitorará isso “à medida que vemos como os desenvolvedores e pesquisadores usam essas ferramentas”.

Ferramentas para desenvolvedores

O Google fornecerá suporte para estruturas populares, como JAX, PyTorch e TensorFlow, por meio do Keras 3.0 nativo – a API de aprendizado profundo desenvolvida pelo Google para implementação de redes neurais.

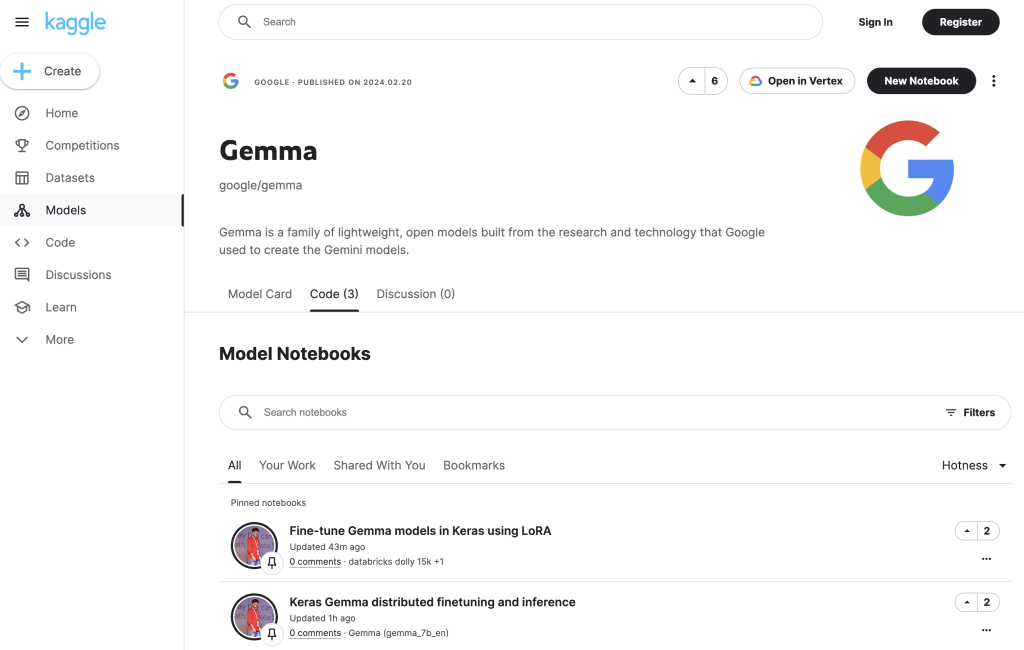

Suporte adicional vem na forma de notebooks Colab e Kaggle prontos para uso, além de integração com ferramentas populares como Hugging Face, MaxText e NVIDIA NeMo.

Gemma sendo usada no Kaggle.

O Google acrescentou que os modelos Gemma pré-treinados e ajustados por instrução podem ser executados em seu laptop, estação de trabalho ou Google Cloud, com opções de implantação para Veex AI e Google Kubernetes Engine (GKE).

Dado que estes são modelos menores do que os modelos de linguagem grande (LLMs) – incluindo os modelos Gemini do próprio Google – que tipos de aplicativos podem ser construídos com o Gemini?

“Portanto, pensamos que há uma grande variedade de aplicações para estes modelos”, disse Warkentin. “Na verdade, se você observar o uso em todo o ecossistema, este é o tamanho mais comum que os desenvolvedores gostariam de usar – o tamanho 7B para geração de texto e compreensão de aplicativos, do ponto de vista do modelo aberto.”

Ele acrescentou que a “qualidade de geração” de tais modelos “aumentou significativamente no ano passado”. Portanto, não é mais necessário usar LLMs para muitos casos de uso de aplicativos.

“Portanto, isso abre maneiras completamente novas de desenvolver aplicativos de IA com as quais estamos muito entusiasmados”, continuou ele, “incluindo a capacidade de executar inferências e fazer treinamento em seu desktop ou laptop de desenvolvedor local, com sua GPU RTX ou em um único host no GCP, com GPUs em nuvem também.”

A postagem Gemma: Google assume pequenos modelos abertos Llama 2 e Mistral apareceu pela primeira vez em The New Stack.