Testando arquiteturas orientadas a eventos com OpenTelemetry

21 de fevereiro de 2024

As previsões do Kubernetes estavam erradas

21 de fevereiro de 2024Para construir um aplicativo de IA generativa, normalmente você precisa de pelo menos dois componentes para começar, um modelo de linguagem grande (LLM) e um armazenamento de dados vetoriais. Você provavelmente também precisará de algum tipo de componente de front-end, como um chatbot.

As organizações que estão entrando no espaço GenAI agora enfrentam um desafio de orquestração com GenAI. Eles descobriram que mover esses componentes do laptop do desenvolvedor para o ambiente de produção pode ser propenso a erros e demorado.

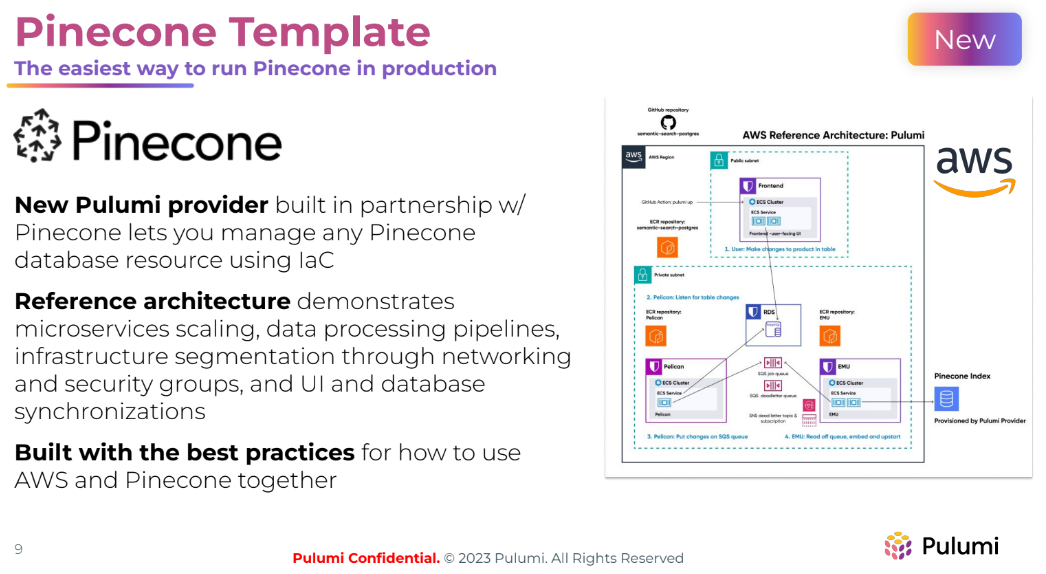

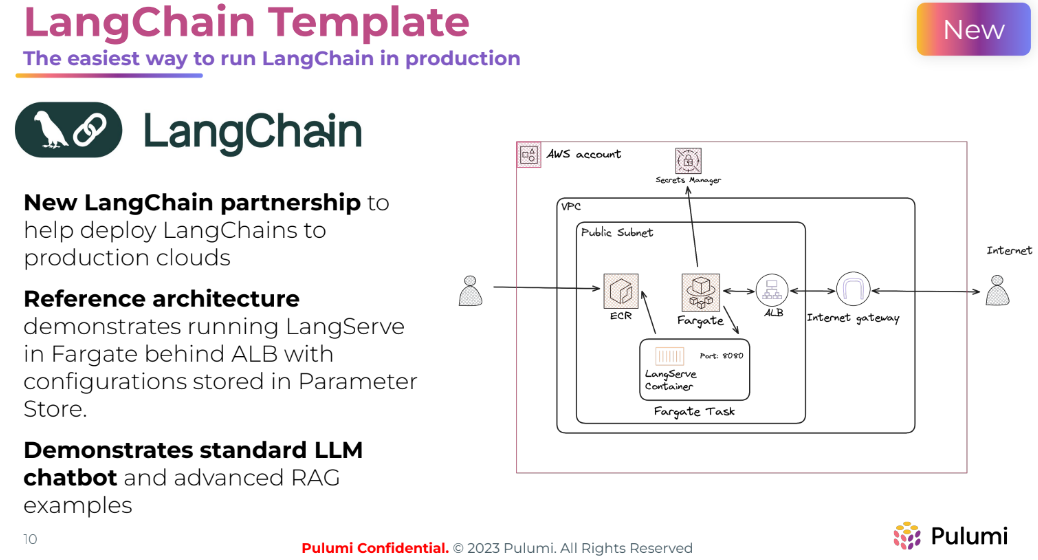

Para facilitar as implantações, Pulumi, fornecedor de software de infraestrutura como código (IaC), introduziu “provedores”, ou modelos, para duas ferramentas essenciais da GenAI, ou seja, o banco de dados vetorial Pinecone e uma versão da estrutura LangChain para construção de LLMs.

“Descobrimos que muitas ferramentas disponíveis, como o LangChain, são ótimas para o desenvolvimento local. Mas quando você quer entrar em produção, fica como um exercício DIY”, disse Joe Duffy, CEO e cofundador da Pulumi, em entrevista ao TNS. “E é muito desafiador porque você deseja arquitetar para escala infinita para que, à medida que você vê sucesso com seu aplicativo, seja capaz de escalar para atender a essa demanda. E isso não é muito fácil de fazer.”

Especificamente, Pulumi oferece suporte à versão sem servidor do Pinecone na AWS, lançada em janeiro, e o suporte ao LangChain vem por meio do LangServe, um serviço de gerenciamento de contêineres desenvolvido no Amazon ECS.

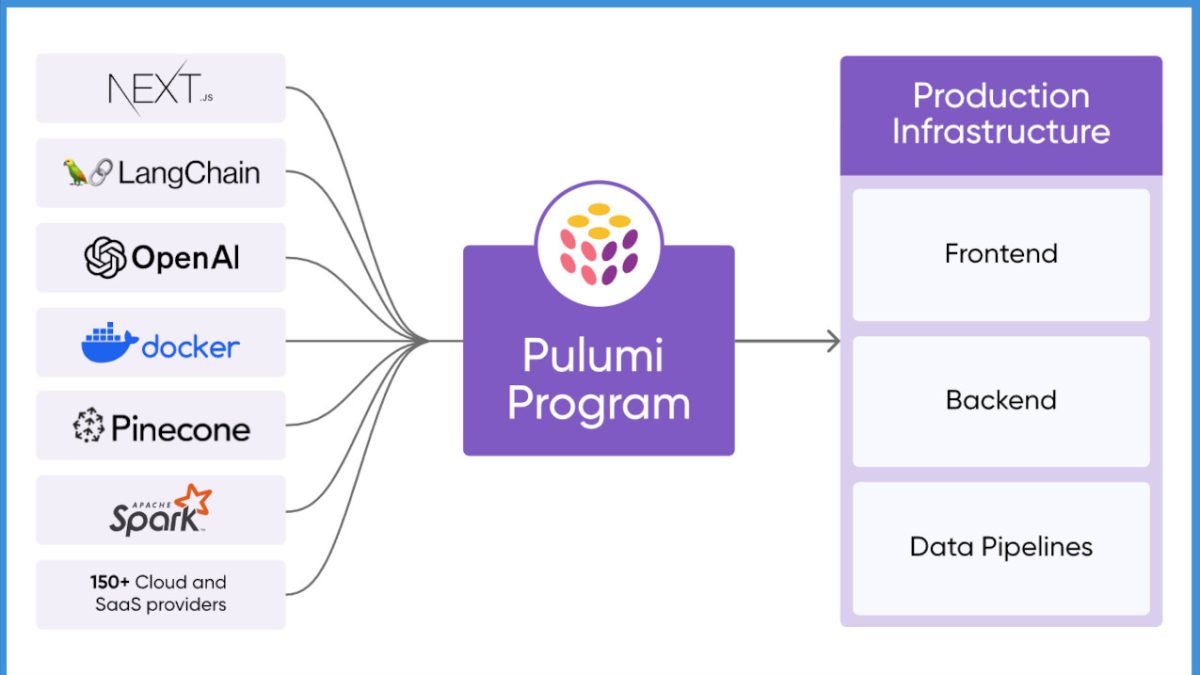

Os dois modelos se juntam a um portfólio que abrange mais de 150 provedores de serviços de nuvem e SaaS, incluindo muitos outros usados no espaço GenAI, como Vercel Next.js para frontend e Apache Spark.

Além dos próprios templates, Pulumi também mapeou um conjunto de arquiteturas de referência que utilizam Pinecone e LangChain.

Como construir uma pilha GenAI usando IaC

A ideia é que o profissional de IA, que pode não ter experiência em operações, possa definir e orquestrar uma pilha de ML com Pulumi, usando outra linguagem Python.

Como uma solução IaC, Pulumi fornece uma maneira de definir declarativamente uma infraestrutura. Ao contrário de outras abordagens IaC, Pulumi permite que o desenvolvedor construa seu ambiente usando qualquer uma das diversas linguagens de programação, como Python, Go, Java e TypeScript.

o mecanismo de implementação pode então provisionar o ambiente definido e até mesmo verificar se o estado operacional permanece sincronizado com o estado definido.

As arquiteturas de referência AI Gen foram projetadas com as melhores práticas em mente, disse Duffy. “Grande parte do desafio é como tornar isso escalável, escalável entre regiões e escalável entre sub-redes e redes. E assim este modelo é construído para uma escala configurável.”

Esta não é a primeira incursão de Pulumi no gerenciamento de infra-estrutura de IA. A empresa já desenvolveu módulos para AWS SageMaker e serviço OpenAI Azure da Microsoft. Há também um plano para implantar um LLM do Hugging Face no Docker, Azure ou Runpod.

Claro, a empresa tem planos de expandir ainda mais a lista daqui para frente.

“Estamos vendo muita aceitação no uso do Pulumi para essas cargas de trabalho de IA”, disse Duffy.

A postagem Modelos Pulumi para pilhas GenAI: Pinecone, LangChain apareceu pela primeira vez em The New Stack.