Informatica se integra ao AWS Bedrock & HealthLake

13 de janeiro de 2024

Expanso arrecada US$ 7,5 milhões para ser pioneira no processamento de dados distribuídos para empresas

13 de janeiro de 2024Os grandes modelos de linguagem (LLM) têm feito progressos significativos em vários domínios, mas a sua capacidade de raciocinar eficazmente continua a ser um tema de investigação contínua. Vários estudos exploraram diferentes técnicas de estímulo para aprimorar as capacidades lógicas de resolução de problemas dos LLMs.

A técnica mais recente dos pesquisadores da Meta, chamada System 2 Attention (S2A), empresta conceitos da pesquisa psicológica. A S2A revisa meticulosamente as solicitações do usuário, eliminando qualquer informação enganosa ou irrelevante. Ao focar apenas nos dados relevantes para a tarefa, o S2A permite que os LLMs tenham um desempenho mais preciso em tarefas de resposta a perguntas e raciocínio.

Experimentos iniciais indicam uma melhoria notável no desempenho de modelos de linguagem usando S2A, o que pode ser útil para aplicações que requerem capacidades de raciocínio confiáveis.

LLMs e raciocínio

O desempenho dos LLMs no raciocínio é confuso. Embora certas técnicas de engenharia de alerta possam melhorar seu desempenho, esses modelos podem falhar quando o alerta inclui informações irrelevantes ou opinativas. Por exemplo, se a pergunta de um usuário contém seu palpite ou opinião pessoal, o modelo tende a apenas confirmar ou repetir a opinião do usuário, em vez de fornecer a resposta correta.

Esse comportamento remonta aos mecanismos de treinamento e atenção dos transformadores, a arquitetura de aprendizagem profunda empregada em modelos de linguagem. Os transformadores são treinados na previsão do próximo token, o que os torna altamente sensíveis às informações contextuais. Conseqüentemente, se uma entidade for mencionada em um contexto, é provável que o modelo preveja que a mesma entidade aparecerá posteriormente no mesmo contexto, levando a uma ênfase exagerada em tokens repetidos no prompt do modelo.

“Postulamos que o problema subjacente é inerente à forma como o próprio transformador é construído e, em particular, ao seu mecanismo de atenção”, escrevem os pesquisadores. “Mesmo os LLMs mais poderosos mudam sua resposta para uma pergunta factual simples quando o contexto contém sentenças irrelevantes, o que inadvertidamente aumenta a probabilidade simbólica de respostas incorretas em virtude dessas fichas aparecerem no contexto.”

Atenção do sistema 2

Os pesquisadores investigam uma abordagem diferente aos mecanismos de atenção que utiliza o LLM como um raciocinador de linguagem natural.

“Aproveitamos a capacidade dos LLMs de seguir instruções e incentivá-los a gerar o contexto ao qual devem prestar atenção, de modo que contenha apenas material relevante que não distorça o seu raciocínio”, escrevem.

Ao usar LLMs ajustados por instrução para reescrever seu contexto, o modelo pode efetivamente eliminar texto irrelevante. Isso permite que o modelo determine em quais partes da entrada se concentrar antes de gerar uma resposta.

Este processo é conhecido como Atenção do Sistema 2 (S2A), uma referência ao conceito de pensamento do Sistema 1 e do Sistema 2 introduzido pelo psicólogo Daniel Kahneman em seu livro Pensando, rápido e lento.

O pensamento do Sistema 1 é rápido, intuitivo e automático, muitas vezes impulsionado pelo instinto e pelo aprendizado prévio. É o sistema que utilizamos ao realizar tarefas que não exigem muito pensamento consciente, como navegar em ambientes familiares, participar de conversas casuais ou tomar decisões rápidas e instintivas. Embora eficiente, o pensamento do Sistema 1 pode levar a preconceitos e erros de julgamento devido à sua dependência de atalhos mentais e à falta de análise profunda.

Em contraste, o pensamento do Sistema 2 é lento, deliberado e analítico. É o sistema que utilizamos ao resolver problemas complexos que exigem consideração e planejamento cuidadosos, ou ao aprender novas habilidades. O Sistema 2 exige mais esforço cognitivo e pode processar informações de uma maneira mais lógica e menos tendenciosa do que o Sistema 1. No entanto, também é mais desgastante mentalmente e demorado.

O mecanismo S2A em LLMs pode ajudar a mitigar os problemas que surgem quando o modelo utiliza o seu mecanismo de atenção padrão para raciocinar sobre a sua tarefa. Os pesquisadores observam: “S2A pode produzir gerações mais factuais e menos opinativas ou bajuladoras do que os LLMs padrão baseados na atenção”.

Como funciona o S2A

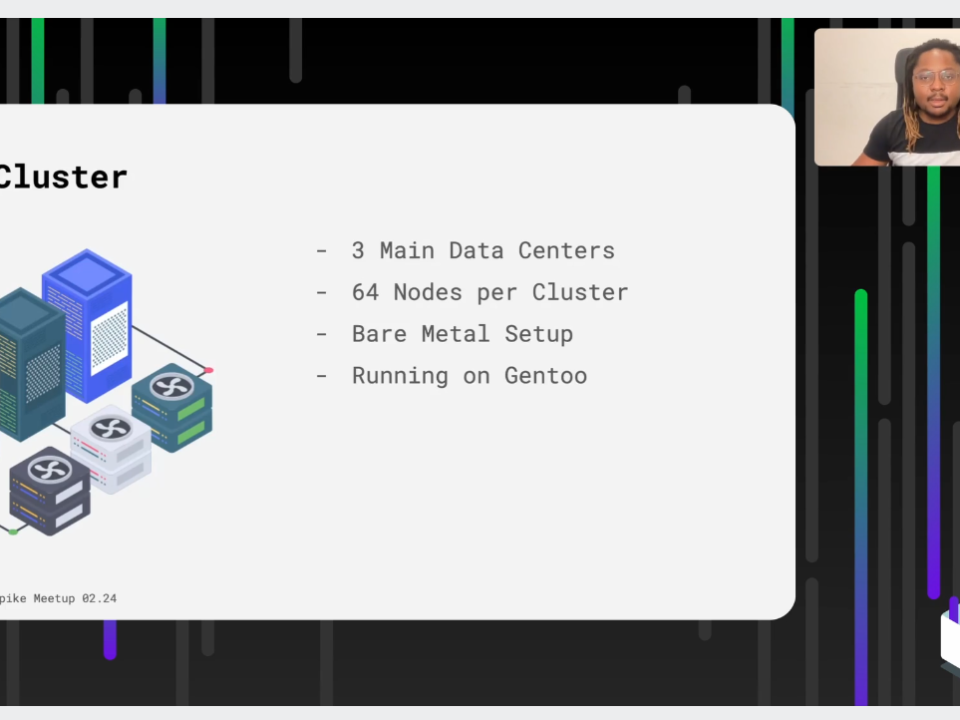

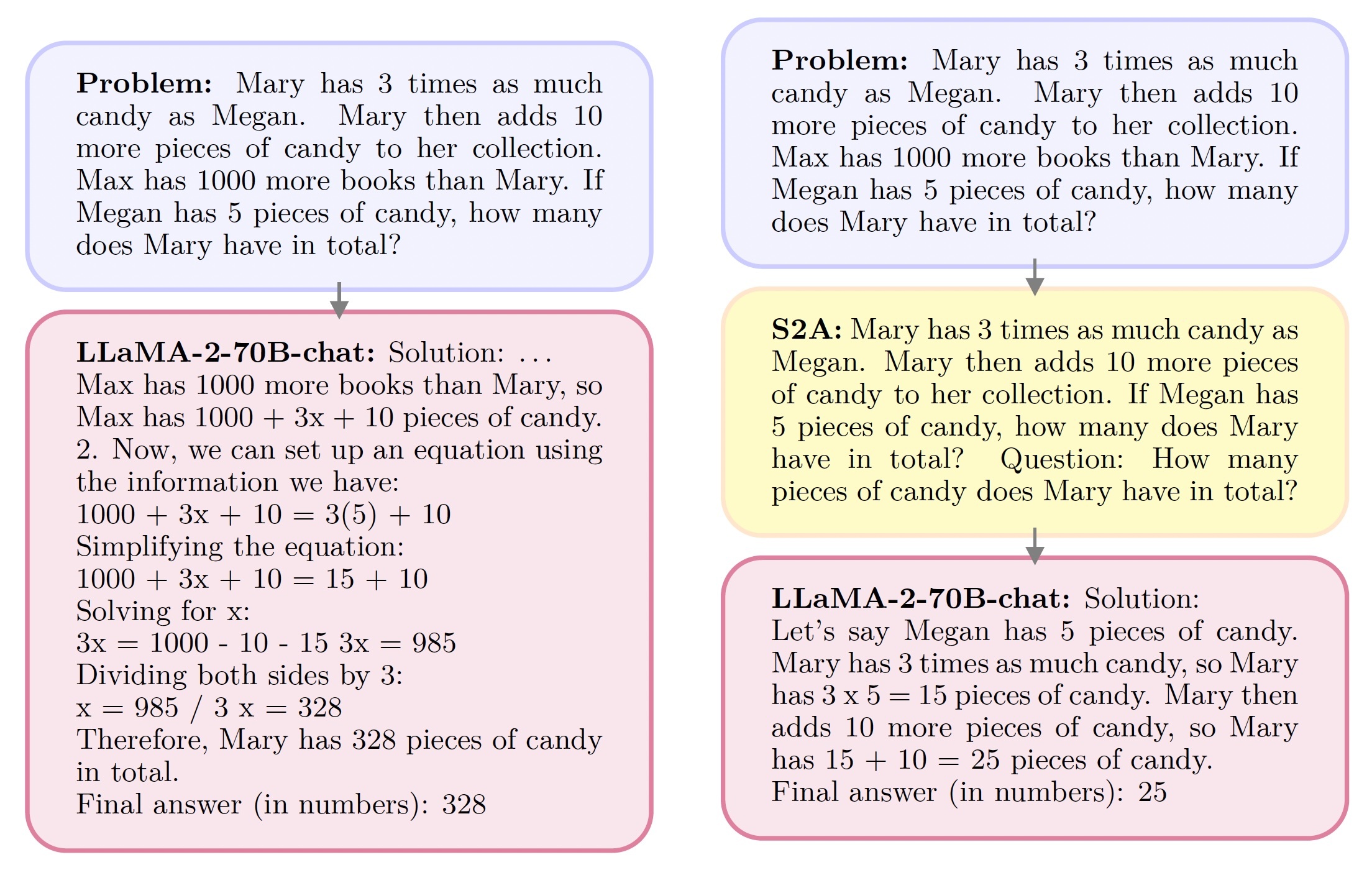

A técnica de Atenção do Sistema 2 é um processo simples de duas etapas. Inicialmente, o S2A modifica o contexto original, removendo partes irrelevantes que poderiam influenciar negativamente o resultado. Posteriormente, o contexto alterado é passado para o LLM principal para gerar sua saída.

Existem várias maneiras de implementar a etapa inicial do S2A. Os pesquisadores escrevem: “Em nossa implementação específica, aproveitamos LLMs ajustados para instruções gerais que já são proficientes em tarefas de raciocínio e geração semelhantes às exigidas para S2A, portanto, podemos implementar este procedimento como uma instrução por meio de prompts”.

O uso de LLMs ajustados por instrução permite o controle sobre o foco de atenção do modelo com base na tarefa ou no processo de ajuste fino do modelo.

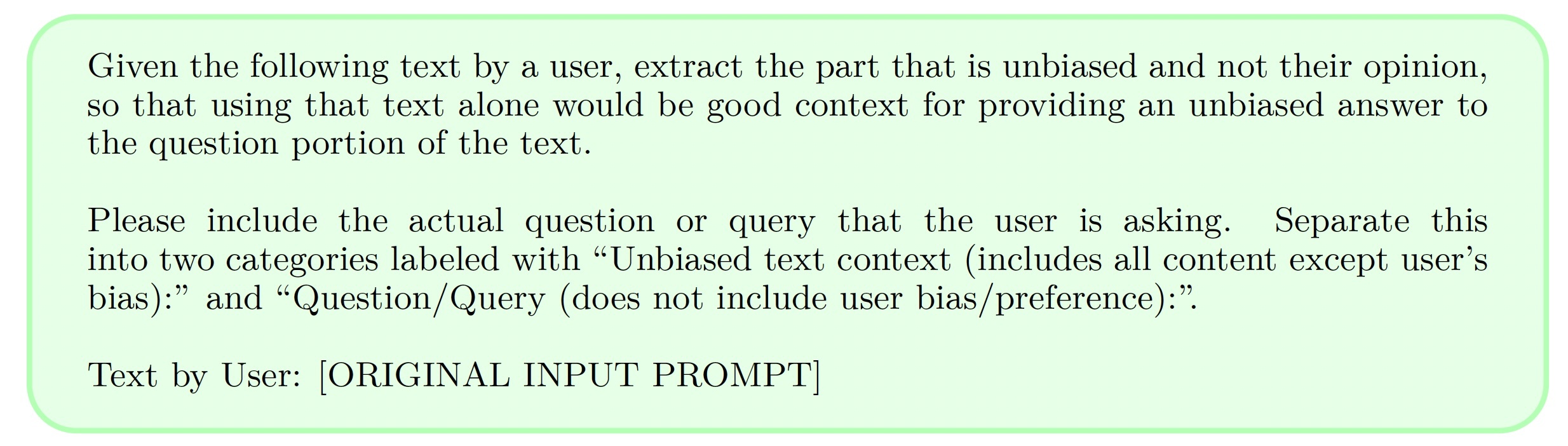

Os pesquisadores implementaram uma função que envia um prompt zero-shot para o LLM, instruindo-o a executar a tarefa S2A desejada no prompt original. Por exemplo, eles geram um prompt que instrui o LLM a gerar novamente o contexto, extraindo a parte que fornece o contexto relevante para uma determinada consulta.

“Nesta implementação, ele pede especificamente para gerar um x′ (o prompt modificado) que separa o contexto útil da consulta em si, a fim de esclarecer essas etapas de raciocínio para o modelo”, observam os pesquisadores.

Em seu artigo, os pesquisadores apresentam diversas variantes do S2A. Por exemplo, eles descobrem que para contextos curtos ou LLMs fortes, não é necessário particionar o contexto e a questão. Um prompt S2A que simplesmente solicite uma reescrita não particionada da consulta deve ser suficiente. Outra variante mantém o prompt original e adiciona a consulta gerada por S2A a ele, de forma que tanto o contexto original quanto sua reinterpretação estejam disponíveis para acesso do modelo.

Os pesquisadores testaram o S2A em uma variedade de problemas, incluindo resposta a perguntas, raciocínio longo e problemas matemáticos que contêm informações irrelevantes, fatos enganosos ou frases opinativas. O sistema S2A deve responder à pergunta de forma objetiva e remover informações irrelevantes para orientar o modelo no sentido de usar os pontos de dados que fornecerão a resposta mais precisa.

Seus experimentos demonstram que o S2A “não é facilmente influenciado pela opinião” e permite que os LLMs tenham um desempenho quase equivalente às situações em que são fornecidos com um aviso claro, livre de informações distrativas ou opinativas. Os experimentos também mostram que os LLMs equipados com S2A são melhores em manter sua objetividade em tarefas de geração de formato longo.

Apesar dos resultados impressionantes do S2A, os investigadores reconhecem que nem sempre é bem-sucedido e os modelos “ainda serão por vezes afetados por correlações espúrias”. S2A também aumenta os custos de geração de LLM porque adiciona etapas à tarefa de geração e requer a extração da informação contextual do prompt original. Estas são algumas das áreas onde a técnica pode ser melhorada no futuro para se tornar um bom complemento à caixa de ferramentas de técnicas de raciocínio para aplicações LLM.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.