Creatio Quantum permite que as empresas implantem aplicativos sem código combináveis

17 de janeiro de 2024

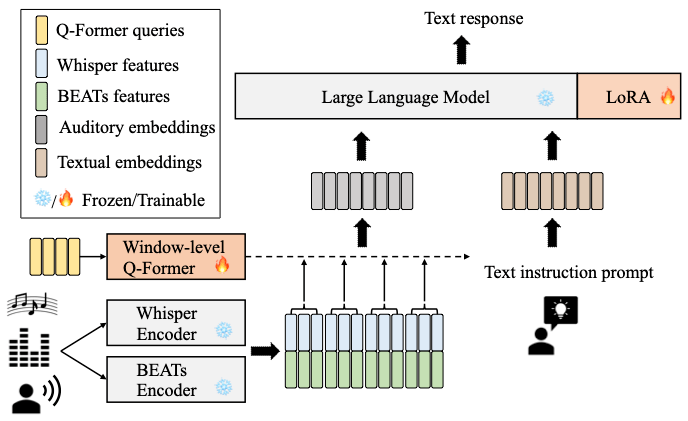

O novo AI SALMONN do criador do TikTok entende todo o áudio, não apenas músicas e vozes

17 de janeiro de 2024A empresa de IA e análise Opaque Systems anunciou hoje novas inovações para sua plataforma de computação confidencial. As novas ofertas priorizam a confidencialidade dos dados organizacionais ao usar grandes modelos de linguagem (LLMs).

A empresa anunciou que apresentará essas inovações durante o discurso principal da Opaque no inaugural Confidential Computing Summit, que será realizado em 29 de junho em São Francisco.

Eles incluem uma IA generativa que preserva a privacidade e é otimizada para a Confidential Computing Cloud do Microsoft Azure e uma plataforma de análise de confiança zero: Data Clean Room (DCR). De acordo com a empresa, sua IA generativa aproveita múltiplas camadas de proteção integrando enclaves de hardware seguros e fortificações criptográficas exclusivas.

“A plataforma Opaque garante que os dados permaneçam criptografados de ponta a ponta durante o treinamento, ajuste fino e inferência do modelo, garantindo assim que a privacidade seja preservada”, disse Jay Harel, vice-presidente de produto da Opaque Systems, à VentureBeat. “Para minimizar a probabilidade de violações de dados ao longo do ciclo de vida, nossa plataforma protege os dados em repouso, em trânsito e durante o uso.”

Através destas novas ofertas, a Opaque pretende permitir que as organizações analisem dados confidenciais com segurança, garantindo ao mesmo tempo a sua confidencialidade e protegendo-as contra acesso não autorizado.

Para apoiar casos de uso confidenciais de IA, a plataforma expandiu seus recursos para proteger o aprendizado de máquina e os modelos de IA. Ele consegue isso executando-os em dados criptografados em ambientes de execução confiáveis (TEEs), evitando assim o acesso não autorizado.

A empresa afirma que suas salas limpas de dados (DCRs) de confiança zero podem criptografar dados em repouso, em trânsito e durante o uso. Esta abordagem garante que todos os dados enviados para a sala limpa permaneçam confidenciais durante todo o processo.

>>Não perca nossa edição especial: Construindo a base para a qualidade dos dados do cliente.<<

Garantindo a segurança dos dados por meio de computação confidencial

LLMs como ChatGPT dependem de dados públicos para treinamento. A Opaque afirma que o verdadeiro potencial desses modelos só pode ser realizado treinando-os nos dados confidenciais de uma organização, sem risco de exposição.

A Opaque recomenda que as empresas adotem a computação confidencial para mitigar esse risco. A computação confidencial é um método que pode proteger os dados durante todo o treinamento do modelo e processo de inferência. A empresa afirma que o método pode desbloquear as capacidades transformadoras dos LLMs.

“Utilizamos a tecnologia Confidential Computing para aproveitar hardware especializado disponibilizado por provedores de nuvem”, disse Harel da Opaque ao VentureBeat. Essa tecnologia que aumenta a privacidade garante que os conjuntos de dados sejam criptografados de ponta a ponta durante todo o ciclo de vida do aprendizado de máquina. Com a plataforma Opaque, o modelo, o prompt e o contexto permanecem criptografados durante o treinamento e durante a execução da inferência.”

Harel disse que a falta de compartilhamento e análise segura de dados em organizações com múltiplos proprietários de dados levou a restrições no acesso aos dados, eliminação de conjuntos de dados, mascaramento de campos de dados e prevenção total do compartilhamento de dados.

Ele disse que existem três questões principais quando se trata de IA generativa e privacidade, especialmente em termos de LLMs:

- Consultas: Os provedores de LLM têm visibilidade das consultas dos usuários, aumentando a possibilidade de acesso a informações confidenciais, como código proprietário ou informações de identificação pessoal (PII). Esta preocupação com a privacidade intensifica-se com o risco crescente de pirataria informática.

- Modelos de treinamento: Para melhorar os modelos de IA, os fornecedores acessam e analisam seus dados internos de treinamento. No entanto, esta retenção de dados de formação pode levar a uma acumulação de informações confidenciais, aumentando a vulnerabilidade a violações de dados.

- Questões de IP para organizações com modelos proprietários: O ajuste fino de modelos usando dados da empresa exige a concessão de acesso aos dados aos provedores proprietários de LLM ou a implantação de modelos proprietários dentro da organização. À medida que indivíduos externos acessam dados privados e confidenciais, o risco de hackers e violações de dados aumenta.

A empresa desenvolveu sua tecnologia de IA generativa com essas questões em mente. O objetivo é permitir a colaboração segura entre organizações e proprietários de dados, garantindo ao mesmo tempo a conformidade regulatória.

Por exemplo, uma empresa pode treinar e aperfeiçoar um LLM especializado, enquanto outra pode usá-lo para inferência. Os dados de ambas as empresas permanecem privados, sem acesso concedido aos da outra.

“Com a plataforma da Opaque garantindo que todos os dados sejam criptografados durante todo o seu ciclo de vida, as organizações seriam capazes de treinar, ajustar e executar inferências em LLMs sem realmente obter acesso aos dados brutos em si”, disse Harel.

A empresa destacou o uso de enclaves de hardware seguros e fortificação criptográfica para a oferta de Data Clean Room (DCR) de confiança zero. Alega que esta abordagem de computação confidencial fornece múltiplas camadas de proteção contra ataques cibernéticos e violações de dados.

Operando em um ambiente nativo de nuvem, o sistema é executado em um enclave seguro na instância de nuvem do usuário (como Azure ou GCP). Esta configuração restringe a movimentação de dados, permitindo que as empresas mantenham a infraestrutura de dados existente.

“Nossa missão é garantir que todos possam confiar na privacidade de seus dados confidenciais, sejam eles PII de clientes ou dados proprietários de processos de negócios. Para cargas de trabalho de IA, permitimos que as empresas mantenham seus dados criptografados e seguros durante todo o ciclo de vida, desde o treinamento e ajuste do modelo até a inferência, garantindo assim que a privacidade seja preservada”, acrescentou Harel. “Os dados são mantidos confidenciais em repouso, em trânsito e durante o uso, reduzindo significativamente a probabilidade de perda.”

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.