Cyera arrecadou US$ 100 milhões para segurança de dados para empresas orientadas por IA

19 de janeiro de 2024

Collective arrecada US$ 50 milhões para plataforma financeira de freelancers com tecnologia de IA

19 de janeiro de 2024Um dos trabalhos menos celebrados da era da Internet é o de moderador de conteúdo.

Casey Newton, Adrien Chen e outros relataram anteriormente de forma eloquente e angustiante sobre a situação desses trabalhadores, que chegam a milhares e são encarregados por grandes redes sociais como o Facebook de revisar tesouros de conteúdo gerado por usuários em busca de violações e removê-los do referido. plataformas.

O conteúdo a que são expostos inclui frequentemente descrições detalhadas e provas fotográficas ou de vídeo do pior da humanidade – tais como representações de abuso sexual infantil – para não mencionar vários outros crimes, atrocidades e horrores.

Os moderadores encarregados de identificar e remover este conteúdo relataram dificuldades com transtorno de estresse pós-traumático (TEPT), ansiedade e várias outras doenças mentais e psicológicas devido à sua exposição.

IA assumindo moderação de conteúdo

Não seria uma melhoria de um programa de inteligência artificial (IA) que poderia arcar com parte, ou potencialmente até a maior parte, da carga de moderação de conteúdo online?

Essa é a esperança da OpenAI, que publicou hoje uma postagem no blog detalhando suas descobertas de que o GPT-4 – seu mais recente modelo de linguagem grande (LLM) disponível publicamente que forma a espinha dorsal de uma versão do ChatGPT – pode ser usado de forma eficaz para moderar conteúdo para outras empresas. e organizações.

“Acreditamos que isso oferece uma visão mais positiva do futuro das plataformas digitais, onde a IA pode ajudar a moderar o tráfego online de acordo com a política específica da plataforma e aliviar a carga mental de um grande número de moderadores humanos”, escreveram os autores da OpenAI, Lilian Weng View, Vik Goel e Andrea Vallone.

Na verdade, de acordo com a pesquisa da OpenAI, o GPT-4 treinado para moderação de conteúdo tem melhor desempenho do que moderadores humanos com treinamento mínimo, embora ambos ainda sejam superados por mods humanos altamente treinados e experientes.

Como funciona a moderação de conteúdo do GPT-4

OpenAI descreve uma estrutura de 3 etapas para treinar seus LLMs, incluindo ChatGPT 4, para moderar conteúdo de acordo com as políticas fornecidas por uma organização hipotética.

A primeira etapa do processo inclui a elaboração da política de conteúdo – presumivelmente isso é feito por humanos, embora a postagem do blog da OpenAI não especifique isso – e então a identificação de um “conjunto de ouro” de dados que os moderadores humanos irão rotular. Esses dados podem incluir conteúdo que viola obviamente as políticas ou conteúdo que é mais ambíguo, mas ainda assim considerado uma violação pelos moderadores humanos. Também pode incluir exemplos de dados que estejam claramente alinhados com as políticas.

Qualquer que seja o conjunto de dados dourado, os rótulos serão usados para comparar o desempenho de um modelo de IA. O segundo passo é pegar o modelo, neste caso GPT-4, e solicitar que ele leia a política de conteúdo e, em seguida, revise o mesmo conjunto de dados “dourado” e atribua a ele seus próprios rótulos.

Finalmente, um supervisor humano compararia a rotulagem do GPT-4 com aquelas originalmente criadas por humanos. Se houver discrepâncias ou exemplos de conteúdo que o GPT-4 “errou” ou rotulou incorretamente, o(s) supervisor(es) humano(s) poderá(ão) pedir ao GPT-4 que explique seu raciocínio para o rótulo. Depois que o modelo descreve seu raciocínio, o humano pode encontrar uma maneira de reescrever ou esclarecer a política de conteúdo original para garantir que o GPT-4 a leia e siga esta instrução daqui para frente.

“Este processo iterativo produz políticas de conteúdo refinadas que são traduzidas em classificadores, permitindo a implantação da política e moderação de conteúdo em escala”, escrevem os autores do OpenAI.

A postagem do blog OpenAI também descreve como essa abordagem se destaca das “abordagens tradicionais de moderação de conteúdo”, ou seja, criando “rótulos mais consistentes” em comparação com um exército de moderadores humanos que podem interpretar o conteúdo de maneira diferente de acordo com a mesma política. um “ciclo de feedback mais rápido” para atualizar as políticas de conteúdo para levar em conta novas violações e, claro, uma “carga mental reduzida” para moderadores de conteúdo humanos, que presumivelmente podem ser chamados apenas para ajudar a treinar o LLM ou diagnosticar problemas com ele, e deixar toda a linha de frente e a maior parte do trabalho de moderação para ele.

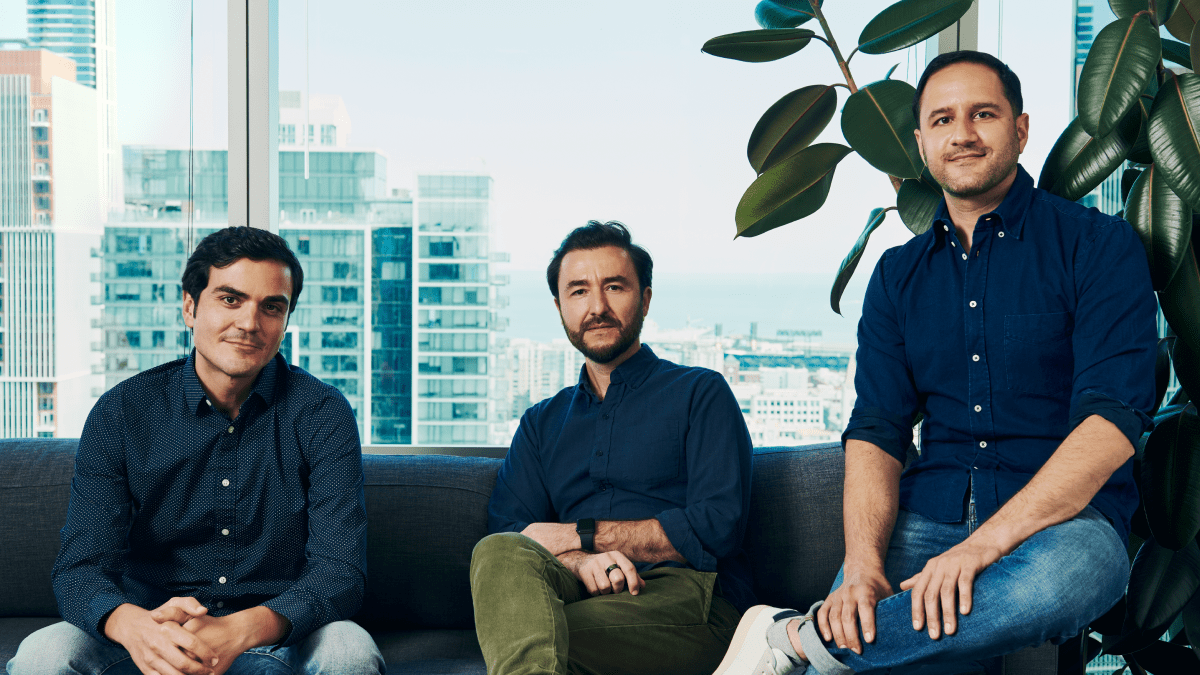

Chamando Antrópico

A postagem no blog da OpenAI e a promoção da moderação de conteúdo como um bom caso de uso para seus LLMs exclusivos fazem sentido, especialmente junto com seu recente investimento e parceria com organizações de mídia, incluindo a Associated Press e o American Journalism Project. As organizações de comunicação social há muito que lutam para moderar eficazmente os comentários dos leitores sobre os artigos, ao mesmo tempo que permitem a liberdade de expressão, discussão e debate.

Curiosamente, a postagem do blog da OpenAI também reservou um tempo para destacar a estrutura de “IA Constitucional” defendida pela rival Anthropic para seus LLMs Claude e Claude 2, nos quais uma IA é treinada para seguir uma única estrutura ética de origem humana em todas as suas respostas. .

“Diferente da IA Constitucional (Bai, et al. 2022), que se baseia principalmente no julgamento internalizado do próprio modelo sobre o que é seguro vs. não, nossa abordagem torna a iteração da política de conteúdo específica da plataforma muito mais rápida e menos trabalhosa”, escrevem os autores do Open AI. “Encorajamos os profissionais de confiança e segurança a experimentar este processo de moderação de conteúdo, já que qualquer pessoa com acesso à API OpenAI pode implementar os mesmos experimentos hoje.”

A escavação ocorre apenas um dia depois que a Anthropic, indiscutivelmente a principal proponente da IA Constitucional, recebeu um investimento de US$ 100 milhões para criar um LLM específico para telecomunicações.

Uma ironia notável

É claro que há uma ironia notável na promoção do GPT-4 pela OpenAI como uma forma de aliviar a carga mental dos moderadores de conteúdo humanos: de acordo com relatórios investigativos detalhados publicados em Tempo revista e Jornal de Wall Streeta própria OpenAI empregou moderadores de conteúdos humanos no Quénia através de prestadores de serviços e subcontratantes como a Sama, para ler conteúdos, incluindo conteúdos gerados por IA, e rotulá-los de acordo com a gravidade dos danos descritos.

Como Tempo relataram, esses trabalhadores humanos recebiam menos de US$ 2 (USD) por hora pelo seu trabalho, e ambos os relatórios indicaram que os trabalhadores sofreram traumas duradouros e doenças mentais devido a isso.

“Um funcionário da Sama encarregado de ler e rotular textos para OpenAI disse Tempo ele sofria de visões recorrentes depois de ler uma descrição gráfica de um homem fazendo sexo com um cachorro na presença de uma criança”, o Tempo afirma o artigo.

Os trabalhadores solicitaram recentemente ao governo do Quénia que promulgasse novas leis que protegessem e fornecessem ainda mais moderadores de conteúdo.

Talvez então, o esforço automatizado de moderação de conteúdo da OpenAI seja, em certo sentido, uma forma de fazer reparações ou prevenir danos futuros como os que estiveram envolvidos na sua criação.

A missão da VentureBeat é ser uma praça digital para os tomadores de decisões técnicas obterem conhecimento sobre tecnologia empresarial transformadora e realizarem transações. Conheça nossos Briefings.