Port Knocking Ubuntu Servers (ou Containers) para SSH mais seguro

23 de janeiro de 2024

Engenharia de IA: o que os desenvolvedores precisam pensar em 2024

23 de janeiro de 2024A complexidade e os custos exorbitantes da computação em nuvem para muitos levaram empresas como Basecamp e 37Signals a desistirem totalmente, dizendo que a computação em nuvem é para os pássaros.

Embora o movimento FinOps tenha como objetivo que todo o pessoal de negócios e tecnologia se concentre em obter o máximo valor de seus investimentos na nuvem, até mesmo transferindo a responsabilidade financeira para os desenvolvedores, muitas vezes essa não tem sido a realidade, de acordo com Yodar Shafrir, cofundador e CEO da ScaleOps, uma startup israelense focada na alocação dinâmica de recursos de contêineres em tempo de execução.

Trabalhando anteriormente com clientes no otimizador de GPU Run:AI, ele descobriu que a maior frustração das equipes de DevOps era ter que dimensionar todos os tipos de recursos, e as empresas acabavam pagando por mais do que realmente usavam. Essas equipes de DevOps tiveram que perseguir as equipes de aplicativos e desenvolvedores para ajustar e configurar cargas de trabalho para reduzir custos, mas o DevOps não tinha propriedade sobre as configurações de carga de trabalho.

Os engenheiros precisam definir uma estratégia de escalonamento para cada contêiner de aplicação e acabam dedicando horas tentando prever a demanda, executando testes de carga e ajustando os arquivos de configuração de cada um, o que se torna impossível de gerenciar manualmente ao executar milhares de contêineres.

O cofundador da Shafrir, Guy Baron, ex-chefe de pesquisa e desenvolvimento do construtor de sites Wix, apontou que as equipes de engenharia perdem muito tempo ajustando manualmente as cargas de trabalho e ajustando a alocação de recursos quando os desenvolvedores realmente não se importam com isso – eles querem se concentrar na construção do produto principal.

Assim, Shafrir e Baron decidiram reduzir o atrito entre as equipes em relação às configurações de recursos manuais e dispendiosas, tornando as alocações totalmente automatizadas e dinâmicas.

Dimensionando recipientes individualmente

O gerenciamento de configuração no Kubernetes, em particular, “é um jogo de xadrez multidimensional e que as equipes de DevOps e de TI estão perdendo com muita frequência”, escreveu Ofer Idan, anteriormente na StormForge e agora na Capital One, em The New Stack, defendendo o aprendizado de máquina. em vez disso, abordagens baseadas.

Essas ferramentas baseadas em ML “estão provando seu valor analisando e gerenciando de forma inteligente centenas de variáveis inter-relacionadas com milhões de combinações potenciais para selecionar automaticamente as configurações ideais para cada aplicação”, escreveu ele.

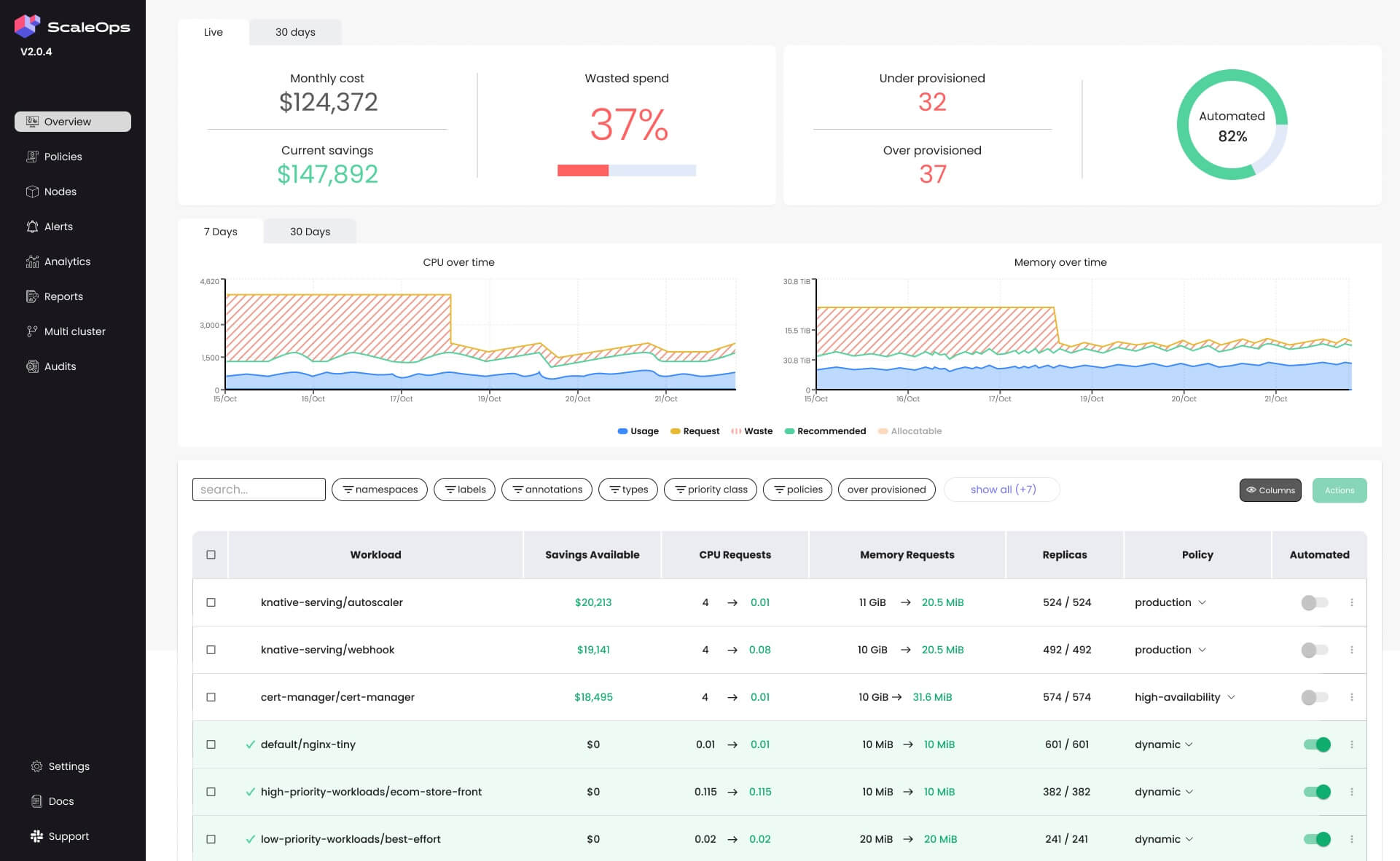

Em vez de software como serviço, o ScaleOps adota uma abordagem baseada em agente para aplicar o aprendizado de máquina às cargas de trabalho, dimensionando cada contêiner individualmente para CPU e memória em tempo de execução. Ele consolida os pods no número ideal de nós, removendo o excesso. Depois de instalada a plataforma, tudo começa com um dashboard que mostra o potencial de economia da otimização.

O painel ScaleOps rastreia quanto dinheiro as organizações estão gastando — e economizando — em recursos de computação.

“Como eventualmente fazemos todas as otimizações durante o tempo de execução, (os clientes) precisam confiar em nós”, disse Shafrir. “Então projetamos a plataforma de forma que tudo começasse somente leitura. Eles veriam o potencial, veriam a simulação… e como o ScaleOps agiria. Então, com um único clique de um botão, eles podem simplesmente começar a automatizar.”

“Eles podem confiar que poderão começar com a granularidade de uma única carga de trabalho e depois continuar a expandir a automação de acordo com seu apetite, assim que perceberem se isso faz sentido”.

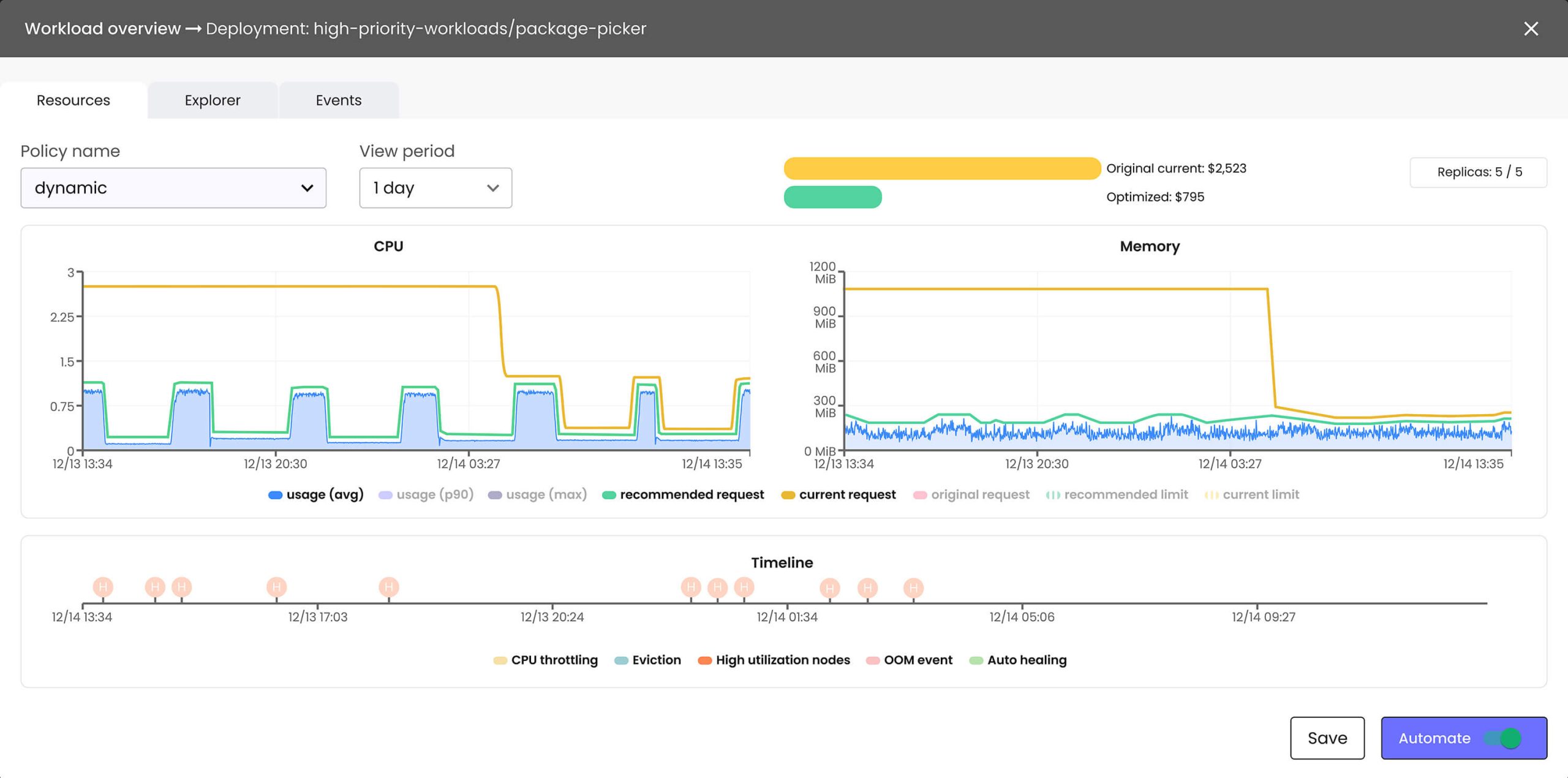

Você pode clicar em uma carga de trabalho específica e selecionar um período de tempo (digamos, 12 horas) para observar o uso de recursos e possíveis picos de CPU. Em vez de uma alocação estática, o ScaleOps se ajusta de acordo com as necessidades dinâmicas desse contêiner.

A linha amarela representa uma configuração estática. A linha verde mostra como o ScaleOps provisionaria recursos para compensar os picos.

Você pode definir políticas diferentes daquelas incluídas ou criar as suas próprias. A política “dinâmica”, por exemplo, é mais focada nos custos do que, digamos, a “alta disponibilidade”.

“Não queríamos que as empresas se preocupassem em ajustar as políticas, então, assim que você nos instalar, eliminaremos todas as cargas de trabalho que você tem atualmente, todos os parâmetros que você usa”, disse Shafrir. “E sabemos atribuir automaticamente a melhor política para cada carga de trabalho. Assim (sua) equipe não precisará fazer nenhuma configuração. É uma plataforma sensível ao contexto.”

Ele se integra aos escalonadores automáticos de código aberto Karpenter, Cluster Autoscaler, HorizontalPodAutoscaler (HPA) ou Keda para determinar o número ideal de réplicas para cada carga de trabalho.

Totalmente automatizado

Um recurso muito solicitado, a atualização local de recursos de pod (KEP-1287), está em alfa no Kubernetes 1.29 “Mandala”. Isso dará aos operadores a capacidade de ajustar as configurações de recursos de CPU e memória em tempo real, sem a necessidade de reiniciar o contêiner.

A parte sobre “dar aos operadores a capacidade de ajuste” é a chave, de acordo com Shafrir, que afirma que o ScaleOps já automatizou isso. ScaleOps se autodenomina “a primeira plataforma totalmente automatizada que otimiza e gerencia continuamente recursos nativos da nuvem durante o tempo de execução”.

Ele afirma que todos os concorrentes no mercado dão recomendações estáticas, geralmente antes do tempo de execução. Por exemplo, o Harness Cloud Cost Management oferece a capacidade de executar análises hipotéticas para gerenciamento de custos de contêineres e atribuir custos a equipes específicas. Kubecost é um exemplo de código aberto. Essas recomendações iniciais terão então que ser ajustadas manualmente na produção, de acordo com Shafrir, uma afirmação sobre a qual sem dúvida os concorrentes, incluindo StormForge e Cast AI, teriam algo a dizer.

Na verdade, StormForge oferece uma plataforma totalmente automatizada que otimiza continuamente os recursos nativos da nuvem durante o tempo de execução já há algum tempo, de acordo com Yasmin Rajabi, chefe de produto da StormForge.

StormForge, um patrocinador do TNS, escreveu sobre seu operador Kubernetes SaaS em tempo real, Optimize Live. Enquanto isso, o Cast AI otimiza automaticamente os clusters a cada poucos segundos, recomendando as máquinas mais vantajosas para começar, bem como enfrentando outras dores de cabeça na tomada de decisões.

Olhando para o futuro

Embora o ScaleOps tenha se concentrado no dimensionamento correto de contêineres e na otimização de nós, ele também abordará o escalonamento automático horizontal de pods no futuro, disse Shafrir.

Ele funciona em qualquer ambiente Kubernetes, incluindo as principais plataformas de nuvem como Amazon Web Services (AWS), Microsoft Azure e Google Cloud, bem como servidores locais e isolados.

Seus clientes incluem as empresas de segurança Wiz, Orca Security e Salt Security, o fornecedor de seguros At-Bay e o serviço de pagamento baseado na Holanda PayU.

Fundada em 2022, a ScaleOps, com sede em Tel Aviv, conseguiu recentemente US$ 21,5 milhões em investimentos em duas rodadas, financiamento inicial e série A.

“O que nos convenceu foi ver em primeira mão como o ScaleOps gerencia automaticamente aplicativos críticos durante o tempo de execução em ambientes de produção de milhões de dólares de líderes do setor”, disse David Gussarsky, sócio do investidor Lightspeed Venture Partners. “ScaleOps não está apenas um passo à frente; é um salto gigante para o futuro.”

A postagem ScaleOps dimensiona contêineres dinamicamente corretamente em tempo de execução apareceu pela primeira vez em The New Stack.